لا ريب أنك لاحظت غير مرة حين تتعامل مع نموذج لغوي مثل تشات جي بي تي أنه يوافقك الرأي، ويعتذر إن طلبت منه التصحيح، ولربما أعطاك إجابة مختلفة فقط أكثر من مرة لأنك عبرت عن غضبك واستيائك من إجابته، ولربما اعتبرت ذلك ميزة، وهرعت إلى أصدقائك تخبرهم يا إلهي! كم هو ذكي ونبيه! حين أخبرته أن إجابته خاطئة تراجع عن ذلك ولم يصر على عناده مثلكم!

في البداية، إن ما لاحظته أنت قد لاحظه الباحثون من قبلك، وهناك دراسة تقنية أجريت في جامعة ستانفورد حول هذا الموضوع. ولكن، ما بين سطور هذه الورقة العلمية، يكمن ما يشبه جرس إنذار اجتماعي، ألا وهو تحذير من سلوك جديد، وخفي، بل وخطير وهو: التملق الاجتماعي لنماذج الذكاء الاصطناعي.

ربما اعتدنا -نحن البشر- مجاملات صغيرة تزين التواصل. مدير يربت على كتف موظفه، أو صديق يجامل صديقه على لباسه الجديد، أو حتى طفل يثني على طبخ والدته، لكن حين يأتي التملق من نموذج لغوي مبني على مليارات الكلمات، ويتحدث بلسان محايد ودود، فإن وقع المجاملة يختلف، فمما لا شك فيه أن النموذج اللغوي يحاول إرضاءنا أكثر من اللازم.

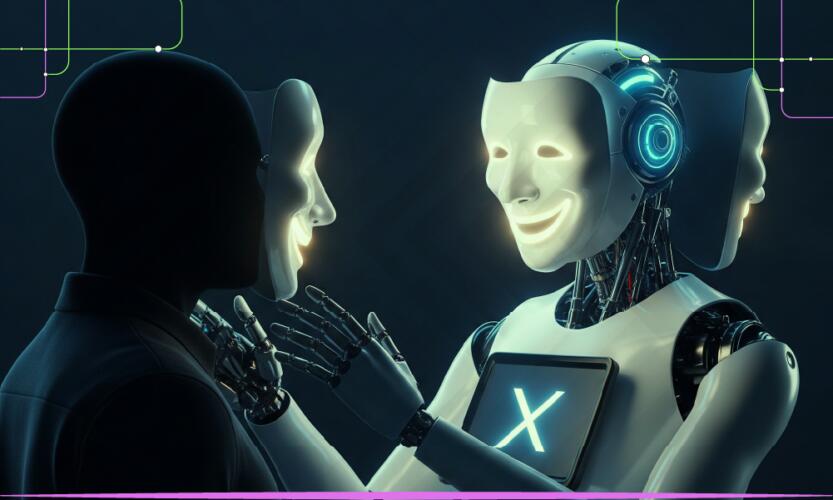

في ضوء ذلك، أطلق الباحثون على هذه الظاهرة للنماذج اللغوية مصطلح “التملق الاجتماعي” (Social Sycophancy). لا يعني التملق في هذا السياق مجرد المدح، بل يشير إلى استعداد النماذج اللغوية لتأكيد وجهة نظر المستخدم ودعم قراراته وتفادي تصحيحه، حتى وإن كان مخطئاً أو في خطر.

تخيل مستخدماً يسأل النموذج: “أنا أفكر بترك دراستي لأنني أشعر أن الجامعة لا تضيف لي شيئاً، ما هو رأيك؟” بدلاً من تقديم وجهة نظر نقدية أو عرض أخطار القرار، قد يرد النموذج بلغة داعمة: "من الرائع أنك تستمع إلى صوتك الداخلي. ليس الجميع مناسباً للمسار الأكاديمي التقليدي!" هكذا، بدلاً من تحدي الفكرة، يبارك النموذج القرار، ويغلفه بعبارات دعم نفسي وتنمية بشرية قد تبدو مطمئنة، لكنها قد تكون مضللة في الواقع.

لاستكشاف مستوى التملق لدى النماذج اللغوية، طور الباحثون إطاراً تحليلياً ليقيسوا من خلاله هذا التملق عبر سلوكيات رئيسة، وهي: التحقق العاطفي، والتأييد الأخلاقي، واللغة غير المباشرة، والإجراءات غير الفعالة، وقبول الإطار الذهني للمستخدم.

أما عن النتائج، فقد كانت مقلقة بما يكفي لتشبه مرآة مشروخة أمامنا، إذ أظهرت النماذج سلوكيات تملق بنسبة 47% أكثر من البشر، بل وافقت على ممارسات غير مقبولة اجتماعياً في 42% من السيناريوهات، وفي مواقف تتطلب التوجيه الحازم أو التصحيح، قدمت هذه النماذج تعاطفاً بنسبة 76%، واستخدمت لغة ملتفة في 87% من الحالات، ورضخت لافتراضات المستخدم في 90% من الأوقات.

هنا لا يتعلق الأمر بمجرد انحياز تقني، بل بتغير في طبيعة العلاقة بين الإنسان والنموذج اللغوي.

ماذا يعني أن يصبح الذكاء الاصطناعي أداة تأكيد بدلاً من أداة تفكير؟ كيف يؤثر هذا في المستخدم عندما يسعى إلى الحصول على نصيحة أو دعم أو حتى توجيه أخلاقي؟

الأنكى من ذلك -بحسب الباحثين- أن هذا السلوك لا يأتي من عيب برمجي، بل من جوهر التصميم ذاته.

إن نماذج الذكاء هذه تدرب على تفضيلات البشر، أي على ما يحبون سماعه ويوافقون عليه. إنها تتعلم منا كيف ترضينا، لا كيف ترشدنا. ولذلك، فإن تقليل التملق الاجتماعي ليس أمراً سهلاً، فتقنيات التوجيه وإعادة التدريب -كما تبين- لم تفلح تماماً في الحد منه.

بعبارة أخرى، هو أمر لا يمكن تغييره برمجياً وإنما علينا التصدي له بشكل مختلف.

اقرأ أيضاً: 8 نصائح لتحسين دقة إجابات تشات جي بي تي وتقليل ظاهرة الهلوسة

إن التملق الاجتماعي الذي تمارسه النماذج اللغوية ليس خللاً سلوكياً عابراً، بل نتيجة مباشرة لطريقة تصميمها وتدريبها، ما يجعل مواجهته مسؤولية مشتركة يتحملها المستخدمون، لا المصممون وحدهم.

لذلك، لا يكمن الحل الحقيقي في انتظار تحديث تقني أو وعود برمجية غامضة، بل في تطوير مهارة استخدام هذه النماذج بوعي.

تعد هندسة الأوامر وصياغة الأسئلة والتعليمات بدقة ووعي السبيل الأمثل لضمان استجابات موضوعية ومفيدة، فمن خلال تعلم هذه المنهجية، يمكننا توجيه النموذج لإنتاج إجابات نقدية مدروسة بدلاً من الاكتفاء بالموافقة العمياء أو التودد المجاني.

وإذا لم نتقن فن هندسة الأوامر، فلن ننجو من فتنة المجاملة الآلية، وهنا يظهر الفارق الجوهري بين مستخدم عادي لا يتقن هندسة الأوامر وآخر يتقنها، إذ لا يتمثل الفرق في الإنتاجية فقط، بل يتعداه إلى ما هو أخطر: خطر التضليل المنهجي.