كنت متوترة ومتأخرة، فليس من السهل أن أختار الملابس التي سأرتديها إلى الأبد. قد يتهيأ لمَن يسمع هذه العبارة أنني أحتضر، لكن الحقيقة هي العكس تماماً. فأنا على وشك أن أعيش إلى الأبد، بطريقة ما، وذلك بفضل الشركة الناشئة المختصة بالذكاء الاصطناعي المخصص للفيديو، سينثيزيا (Synthesia). كانت الشركة تنتج على مدى عدة سنوات سابقة شخصيات رمزية رقمية مُوَلدة باستخدام الذكاء الاصطناعي، لكنها الآن أطلقت جيلاً جديداً من هذه الشخصيات الرمزية الرقمية، وهو الجيل الأول الذي يستفيد من أحدث التطورات في الذكاء الاصطناعي التوليدي، كما أن هذه الشخصيات الرمزية واقعية ومعبرة إلى حد يفوق أي شيء سبق لي أن رأيته. وعلى حين أن هذا الإصدار يعني أن أي شخص تقريباً سيتمكن من الحصول على نسخة رقمية لنفسه، فقد وافقت الشركة على صُنع نسخة لي في عصر ذلك اليوم من أوائل أبريل/نيسان، قبل نشر هذه التكنولوجيا بين العامة.

في هذا المقطع المُوَلد بالذكاء الاصطناعي، تقدم "ميليسا" الاصطناعية عرضاً لمناجاة هاملت الشهيرة. (لم تضطلع المجلة بأي دور في إنتاج هذا الفيديو)

مصدر الفيديو: سينثيزيا

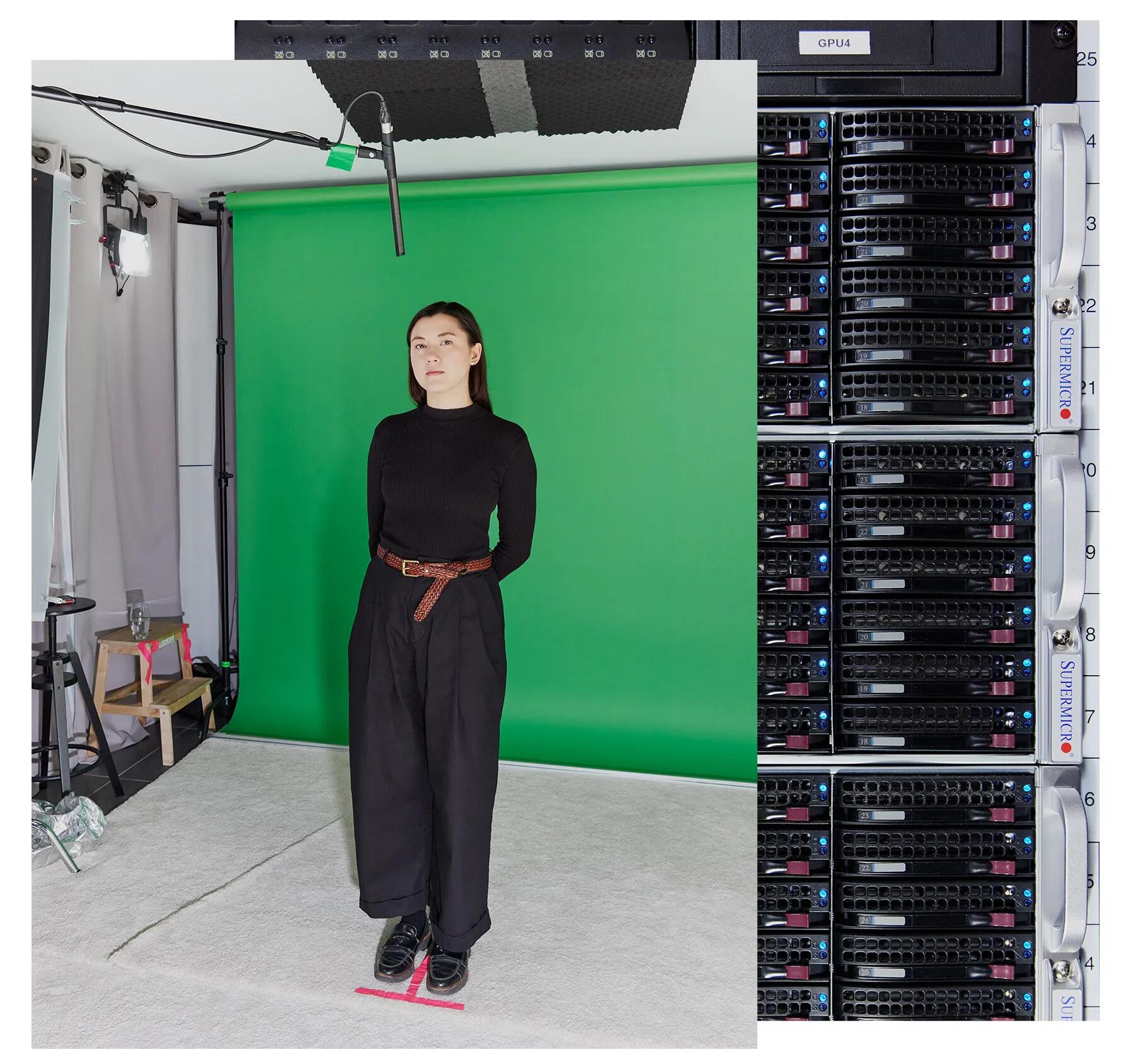

عندما وصلت أخيراً إلى الاستوديو الأنيق التابع للشركة في المنطقة الشرقية من لندن، استقبلني مدير الإنتاج في الشركة، توسين أوشينييمي. كان أوشينييمي سيرشدني ويوجهني عبر عملية جمع البيانات -وتعني عبارة "جمع البيانات" (data collection) هنا التقاط ملامح وجهي وحركاتي المميزة وغير ذلك، تماماً كما يفعل عادة مع الممثلين وعملاء سينثيزيا.

قدمني بعد ذلك إلى مختص بالأزياء ومختص بالتجميل كانا في انتظاري، وندمت كثيراً على إضاعة ذلك الوقت كله في تجهيز نفسي. وكان عملهما يتلخص بضمان ارتداء الأشخاص ملابس من النوع الذي يظهر بمظهر أنيق أمام الكاميرا، والحفاظ على اتساق المظهر الخارجي بين لقطة وأخرى. أخبرني مختص الأزياء أن ملابسي كانت جيدة (يا للراحة)، أمّا مختص التجميل فقد وضع بعض اللمسات على وجهي ورتب شعري قليلاً. كانت غرفة تبديل الملابس مزينة بمئات الصور الفورية لأشخاص مبتسمين صُنِعت نسخ رقمية منهم قبلي.

وبصرف النظر عن الكمبيوتر الخارق الصغير الذي كان يئزّ في الردهة، وهو مخصص لمعالجة البيانات المولدة في الاستوديو، فقد كانت هذه الزيارة أقرب إلى زيارة إلى استوديو إخباري منها إلى دخول مكان شبيه بمصنع لإنتاج المزيفات العميقة. قلت لأوشينييمي على سبيل المزاح إنه يحمل ما يمكن أن تُطلق عليه مجلة إم آي تي تكنولوجي ريفيو مسمى وظيفياً مستقبلياً وهو "مدير إنتاج المزيفات العميقة" (deepfake creation director).

وقال أوشينييمي: "نفضّل استخدام مصطلح ’الوسائط الاصطناعية‘ (synthetic media) بدلاً من المزيفات العميقة".

مصدر الصورة: ديفيد فينتينر

فرق دلالي في التعابير

إنه فرق بسيط في دلالة الكلمات، لكن البعض قد يقول إنه فرق ملحوظ أيضاً. يعني كلا المصطلحين مقاطع الفيديو أو التسجيلات الصوتية التي يولّدها الذكاء الاصطناعي لأشخاص يفعلون أو يقولون أشياء لم تحدث بالضرورة في الحياة الواقعية. لكن المزيفات العميقة تتسم بسمعة سيئة. فمنذ ظهورها قبل عقد تقريباً من الزمن، ارتبط المصطلح بالأشياء غير الأخلاقية، كما يقول مدير شؤون الشركات والسياسات في سينثيزيا، ألكسندرو فويكا. وفي أذهاننا، يشير المصطلح إلى المحتوى الجنسي الذي يجري إنتاجه دون موافقة الأشخاص الذين يظهرون فيه، أو الحملات السياسية التي تنشر معلومات مضللة أو دعايات مغرضة.

يقول فويكا: "تمثّل الوسائط الاصطناعية وصفاً لهذا المفهوم يميلُ بدرجة أكبر إلى الأمان والفائدة". وتسعى سينثيزيا إلى تقديم أفضل نسخة من هذا الوصف. حتى الآن، كانت مقاطع الفيديو التي يظهر فيها بشر والمولّدة باستخدام الذكاء الاصطناعي، تميلُ كلها إلى الافتقار إلى السلاسة أو الاحتواء على بعض العيوب أو غير ذلك من العناصر غير الطبيعية التي تجعل تمييزها عن الواقع سهلاً للغاية. ونظراً لكون هذه المقاطع قريبة للغاية من الواقع ولكنها غير مطابقة تماماً له، فمن الممكن أن تُثير لدى البشر شعوراً بالانزعاج أو الضيق أو النفور، وهي ظاهرة تُعرف باسم الوادي الغريب (uncanny valley). تزعم سينثيزيا أن تكنولوجيتها الجديدة ستخرجنا أخيراً من هذا الوادي.

اقرأ أيضاً: تأثير الذكاء الاصطناعي التوليدي في الإنتاجية المهنية للبشر

فبفضل التطورات السريعة التي تتحقق في الذكاء الاصطناعي التوليدي، إضافة إلى وفرة بيانات التدريب التي ولّدها الممثلون البشر ولُقِّمَت إلى نموذج الذكاء الاصطناعي الخاص بشركة سينثيزيا، تمكنت الشركة من إنتاج شخصيات رمزية رقمية أقرب إلى البشر بالفعل وأكثر قدرة على التعبير من سابقاتها. تتمتّع هذه النسخ الرقمية بقدرة أعلى على مطابقة ردود فعلها ونبرة صوتها مع المشاعر الواردة في النصوص المقدمة إليها، حيث تتصرف على نحو أكثر إيجابية عند التحدث عن أشياء تبعث على السعادة على سبيل المثال، وتصبح أكثر جدية أو حزناً عند التحدث عن أشياء لا تبعث على السرور. كما أنها أفضل أداء فيما يتعلق بمطابقة التعابير الوجهية، أي تلك الحركات الصغيرة التي يمكنها أن تتحدث نيابة عنا دون كلمات، غير أن هذا التقدم التكنولوجي يمثّل دلالة تعبّر أيضاً عن تحول أكبر بكثير على الصعيدين الاجتماعي والثقافي. فقد أصبح الكثير مما نراه على شاشاتنا، وبصورة متزايدة، مُوَلداً باستخدام الذكاء الاصطناعي (أو على الأقل مُعَدلاً باستخدامه)، كما أصبح من الصعب أكثر فأكثر تمييز الحقيقي من المزيف على نحو غير مسبوق.

يهدد هذا الأمر ثقتنا بأي شيء نراه، ما يمكن أن يؤدي إلى عواقب حقيقية ووخيمة للغاية. تقول الأستاذة في معهد أوكسفورد للإنترنت، ساندرا واتشر، التي تجري الأبحاث حول الآثار القانونية والأخلاقية للذكاء الاصطناعي: "أعتقد أننا قد نودع الزمن الذي كنا قادرين فيه على التوصل إلى الحقيقة بسرعة. إن فكرة إجراء بحث سريع وبسيط باستخدام محرك جوجل لتحديد المعلومات الحقيقية والمعلومات المزيفة قد تصبح غير ممكنة بعد الآن". ولهذا، وعلى الرغم من حماستي إزاء الحصول على نسختي الرقمية من سينثيزيا، فقد كنت أتساءل أيضاً عمّا إذا كان التمييز بين الوسائط الاصطناعية والمزيفات العميقة لا يحمل أي معنى جوهري. فحتى إذا كان المفهوم الأول بينهما يتمحور حول نية الصانع، والأهم من ذلك، موافقة الشخص صاحب النسخة، فهل هناك فعلاً طريقة لصنع الشخصيات الرمزية الرقمية لأغراض الذكاء الاصطناعي بأمان إذا كانت النتيجة النهائية هي ذاتها في الحالتين؟ وهل نرغب فعلاً في الخروج من الوادي الغريب إذا كان هذا سيؤدي بنا إلى فقدان القدرة على تحديد الحقيقة؟

لكن الأمر الأكثر إلحاحاً هو أن الوقت كان قد حان لرؤية ما سيحدث عند مواجهة نسخة شخصية من نفسك تنتمي إلى مرحلة ما بعد الحقيقة.

أقرب ما يكون إلى الواقع

قبل رحلتي إلى الاستوديو بشهر، زرت الرئيس التنفيذي لسينثيزيا، فيكتور ريباربيلي، في مكتبه بالقرب من ميدان أوكسفورد. ووفقاً لما قاله ريباربيلي، تنبع قصة منشأ سينثيزيا من تجاربه في استكشاف موسيقى التكنو العصرية والغريبة الأطوار عندما كان يافعاً في الدانمارك. فقد تمكن بفضل الإنترنت من تنزيل البرمجيات وإنتاج أغانيه الخاصة دون شراء أجهزة توليد الأصوات الموسيقية الباهظة الثمن.

وقال لي: "أنا أؤمن بشدة بضرورة منح الناس القدرة على التعبير عن أنفسهم بأي طريقة ممكنة يجدون إليها سبيلاً، لأنني أعتقد أن هذا سيؤدي إلى زيادة قيمة الكفاءة والجدارة في هذا العالم". وجد ريباربيلي فرصة سانحة في تحقيق شيء مماثل في مجال الفيديو عندما صادف بحثاً حول استخدام التعلم العميق في نقل التعابير من وجه بشري إلى وجه بشري آخر على الشاشة. وقال: "أظهر لي ذلك البحث أنها كانت المرة الأولى التي تُستَخدم فيها شبكة تعلم عميق لإنتاج لقطات فيديو تبدو حقيقية ومقنعة".

أجرى ذلك البحث الأستاذ في جامعة ميونيخ التقنية (Technical University of Munich)، ماتياس نيسنر، الذي شارك في تأسيس سينثيزيا مع ريباربيلي في 2017، إضافة إلى الأستاذين لوردس أغابيتو وستيفن تييريلد من كلية لندن الجامعية، اللذين عمل معهما ريباربيلي من قبل في مشروع يتعلق بالعملات المشفرة. في البداية، كانت الشركة تبني أدوات لمزامنة الشفاه والدبلجة للاستخدام في مجال الترفيه، لكنها وجدت أن معايير الجودة لهذه التكنولوجيا كانت مرتفعة للغاية، وأن الطلب عليها ضعيف. غيّرت سينثيزيا اتجاهها في 2020، وأطلقت أول جيل من الشخصيات الرمزية الرقمية لأغراض الذكاء الاصطناعي للعملاء من الشركات، وقد أتت هذه النقلة بثمارها. ففي 2023، حققت سينثيزيا لقب المؤسسة "الأحادية القرن" (Unicorn)، ما يعني أن قيمتها تجاوزت المليار دولار، وأصبحت إحدى شركات الذكاء الاصطناعي الأوروبية القليلة نسبياً التي تمكنت من تحقيق هذا الإنجاز.

كان الجيل الأول من الشخصيات الرمزية الرقمية غريب الشكل، ويعتمد على حركات متكررة دون تنويع يُذكر. وعلى الرغم من أن الإصدارات اللاحقة بدأت تحمل طابعاً أقرب إلى البشر، فقد كانت تجد صعوبة في نطق الكلمات المعقدة، وكانت حركاتها تفتقر نوعاً ما إلى التزامن الصحيح. يكمن التحدي في أن الناس معتادون على النظر إلى وجوه الأشخاص الآخرين. يقول الرئيس التنفيذي للتكنولوجيا في سينثيزيا: "نعرف نحن البشر كيف يتصرف البشر الحقيقيون". فمنذ الولادة، "نعتاد إلى درجة كبيرة على الأشخاص والوجوه، ونعلم كيف يبدو الشكل الطبيعي، ولهذا يمكننا كشف أي خطأ واضح من مسافة كبيرة".

أُنتِجَت هذه المقاطع الأولى المُوَلدة باستخدام الذكاء الاصطناعي، شأنها شأن المزيفات العميقة عموماً، باستخدام الشبكات التوليدية التنافسية (GANs)، وهي تقنية أقدم لتوليد الصور والفيديو تعتمد على شبكتين عصبونيتين تعملان على نحو متكامل. كانت عملية الإنتاج مضنية ومعقدة، وكانت هذه التكنولوجيا غير مستقرة. لكن الشركة وجدت في مرحلة ازدهار الذكاء الاصطناعي التوليدي في العام المنصرم تقريباً أنها تستطيع إنتاج شخصيات رقمية أفضل بكثير من خلال الشبكات العصبونية التوليدية التي تنتج جودة أعلى بصورة أكثر اتساقاً. كلما زادت البيانات التي تُقدَّم إلى النماذج، تعلمت بصورة أفضل. استخدمت سينثيزيا النماذج اللغوية الكبيرة ونماذج الانتشار لتحقيق هذا الأمر، فقد ساعدت النماذج اللغوية الكبيرة الشخصيات الرقمية على التفاعل مع النص بصورة أفضل، على حين تولت نماذج الانتشار مهمة توليد البيكسلات.

وعلى الرغم من القفزة التي حققتها الشركة على صعيد الجودة، ما زالت تحجم عن الترويج لخدماتها في مجال الترفيه. وما زالت سينثيزيا تعد نفسها منصة لأعمال تجارية، وتراهن الشركة على ما يلي: يقضي الناس وقتاً أطول في مشاهدة مقاطع الفيديو على يوتيوب وتيك توك (TikTok)، وسيؤدي هذا إلى زيادة الطلب على محتوى الفيديو. وقد بدأ اليافعون منذ الآن يستغنون عن عمليات البحث التقليدية، ويلجؤون إلى تيك توك للحصول على المعلومات التي تقدّمها هذه المنصة إليهم في صيغة مقاطع فيديو. يقول ريباربيلي إن تكنولوجيا سينثيزيا يمكن أن تساعد الشركات على تحويل أساليب التواصل والتقارير ومواد التدريب لدى الشركات من شكلها الحالي الرتيب والممل إلى محتوى سيشاهده الناس ويتفاعلون معه بصورة فعلية، كما أنه يشير إلى إمكانية استخدام هذه التكنولوجيا لإنتاج مواد تسويقية.

ويزعم أن 56% من الشركات المدرجة ضمن قائمة فورتشن 100 (Fortune 100) تستخدم تكنولوجيا سينثيزيا، كما أن الأغلبية العظمى من هذه الشركات تستخدمها لأغراض التواصل الداخلي. وتقول الشركة إن مجموعة عملائها تضم شركات زوم (Zoom) وزيروكس (Xerox) ومايكروسوفت ووكالة رويترز (Reuters) للأنباء. وتبدأ رسوم خدمات الشركة من 22 دولاراً شهرياً. وتأمل الشركة بأن هذه الخدمات ستكون بديلاً أقل تكلفة وأكثر فاعلية لمقاطع الفيديو التي تنتجها شركات إنتاج احترافية، وتأمل أيضاً بأن هذا البديل سيصبح تقريباً بمستوى جودة يصعب تمييزه عما تنتجه تلك الشركات. قال لي ريباربيلي إن الشخصيات الرقمية من الجيل الأحدث لدى الشركة قادرة بسهولة على خداع أي شخص ودفعه إلى الاعتقاد بأنها حقيقية. ويقول: "أعتقد أننا حققنا الهدف المنشود بنسبة 98%". على أي حال، أنا على وشك أن أرى النتيجة بنفسي.

اقرأ أيضاً: تعرّف إلى أبرز شركات التكنولوجيا العربية في قائمة فورتشن 500

لا تنتج بيانات رديئة

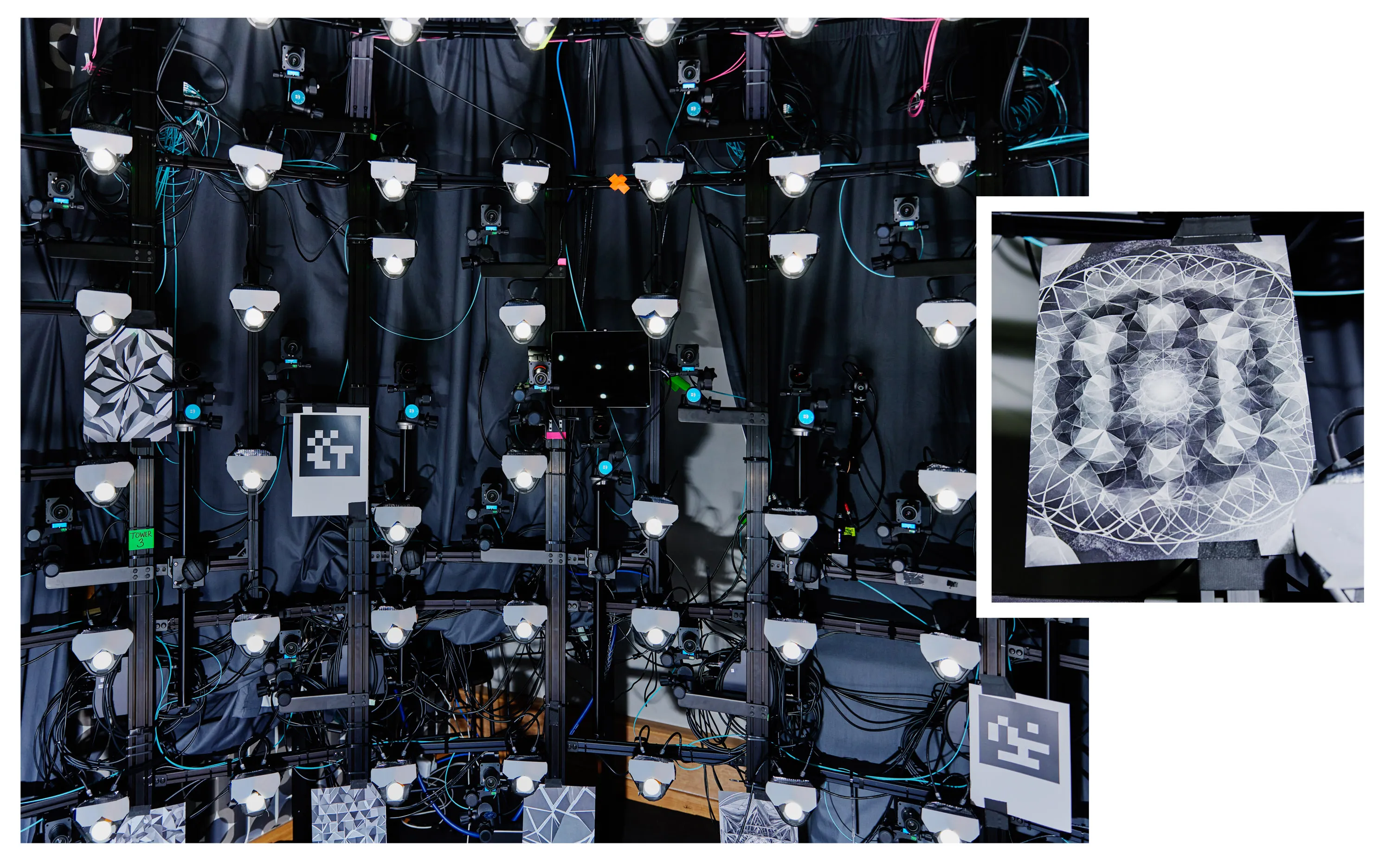

ثمة قول شائع في أوساط أبحاث الذكاء الاصطناعي: إذا كانت المدخلات رديئة، فستكون المخرجات رديئة. ويعني هذا أنه إذا كانت البيانات المستخدمة في تدريب نموذج الذكاء الاصطناعي رديئة، فسوف ينعكس هذا على نتاج النموذج، كما يعني أن مستوى الواقعية للشخصية الرقمية سيزداد مع ازدياد عدد نقاط البيانات التي يلتقطها نموذج الذكاء الاصطناعي للتعبير عن حركات وجهي، وتعابيري الدقيقة، وحركات الرأس، وطرفات العينين، وحركات الكتفين، وتلويحات اليدين.

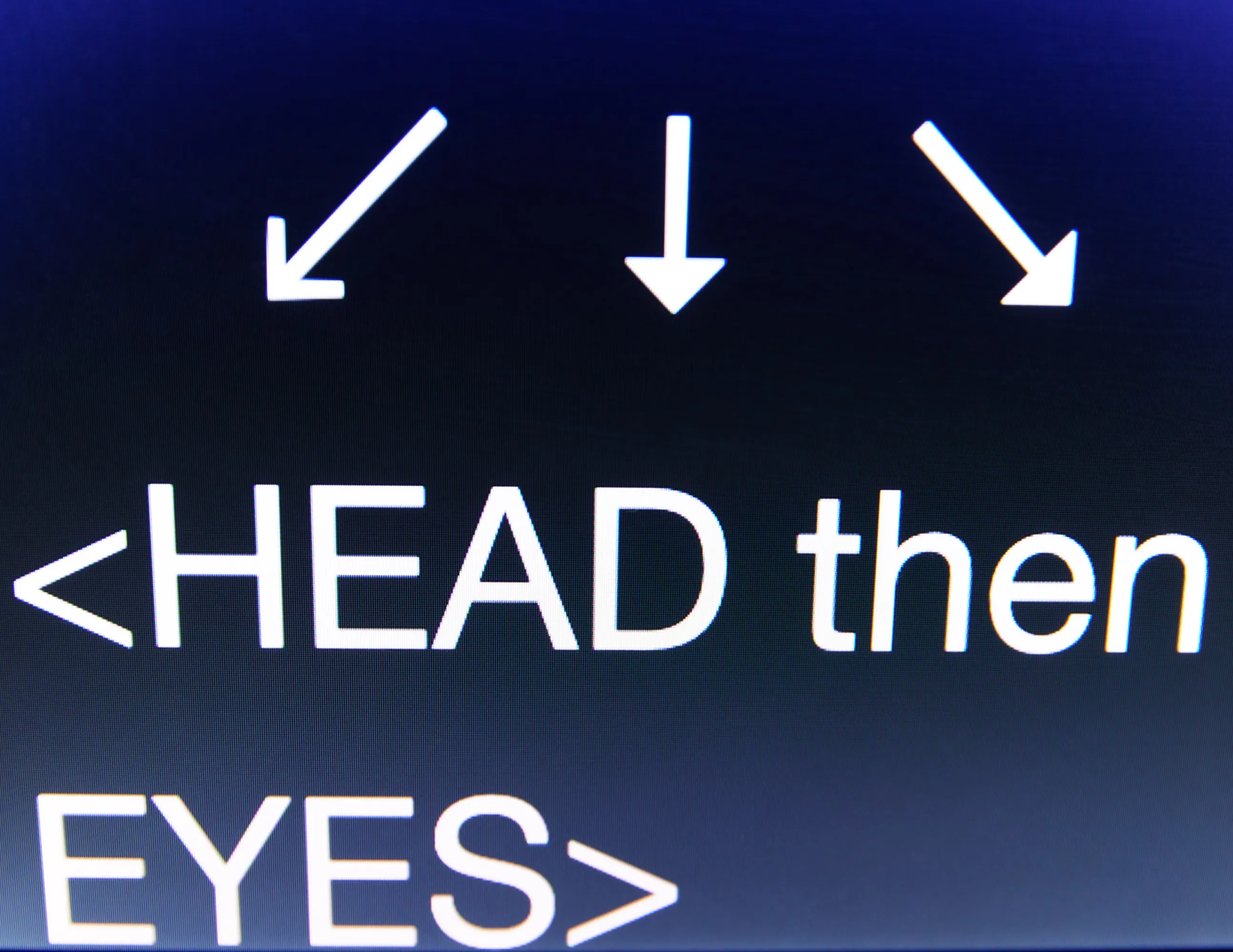

عندما كنت في الاستوديو، كنت أحاول جاهدة حتى لا تكون بياناتي رديئة. كنت أقف أمام شاشة خضراء، وكان أوشينييمي يوجهني خلال عملية المعايرة الأولية، حيث يجب أن أحرك رأسي ثم عيني في حركة دائرية. على ما يبدو، هذه العملية ضرورية حتى يتمكن النظام من استيعاب ألواني وملامحي الوجهية الطبيعية. بعد ذلك، طُلِب مني أن أقول هذه الجملة: "كل الأولاد أكلوا سمكة" (All the boys ate a fish)، وهي ضرورية لالتقاط حركات الفم الضرورية جميعها لإصدار الأحرف الصوتية والساكنة لدي. كما صُورت لقطات لي وأنا في "حالة خمول" يخيم علي الصمت.

مصدر الصورة: ديفيد فينتينر

ثم طلب مني قراءة نص لمقطع تخيلي على يوتيوب بنبرات مختلفة، حيث وجّهني محدداً مجموعة من المشاعر التي يجب أن أعبّر عنها. ففي المرة الأولى، كان يجب أن أقرأ النص بأسلوب حيادي وإخباري، ثم بأسلوب تشجيعي، ثم بأسلوب يعبّر عن الانزعاج والتذمر، ثم أخيراً بأسلوب مقنع ومفعم بالحماسة. "مرحباً بكم جميعاً، وأهلاً بكم مرة أخرى في إيليفيت هير "Elevate Her" مع مضيفتكم، جيس مارس. من الرائع أن تكونوا معنا هنا. سنتحدث عن موضوع فائق الحساسية، وهو بصراحة يعنيني شخصياً للغاية، ويتعلق بالتعامل مع النقد خلال رحلتنا الروحانية"، كنت أقرأ نقلاً عن شاشة التلقين، محاولة في الوقت نفسه أن أتخيل أنني أتحدث إلى شريك حياتي بانفعال خلال النسخة التي تتطلب مني التحدث بأسلوب يوحي بالتذمر. تابعت القراءة قائلة: "كيفما نظرنا، يبدو أنه ثمة صوت ناقد جاهز للتدخل والإدلاء بدلوه، أليس كذلك؟"

في الوقت نفسه، كنت أردد في ذهني قائلة: "لا تنتجي بيانات رديئة مثل القمامة". "كان هذا جيداً للغاية. فقد كنت أشاهد ما يحدث، وبدا لي المشهد حقيقياً. إنها تتذمر دون شك"، كما قال أوشينييمي مشجعاً. واقترح عليّ أن أضيف في المرة المقبلة شيئاً من الاستنكار.

صورنا عدة لقطات تعرض أشكالاً مختلفة من أداء النص. ففي بعض النسخ، سُمِح لي بتحريك يدي. وفي نسخ أخرى، طلب مني أوشينييمي أن أحمل دبوساً معدنياً بين أصابعي في أثناء تحريك يدي. وقال أوشينييمي إن هذا الإجراء مخصص لاختبار "حدود" إمكانات هذه التكنولوجيا فيما يتعلق بالتواصل باستخدام اليدين. كان إنتاج شخصيات رقمية باستخدام الذكاء الاصطناعي وتصميم يتميز بمظهر طبيعي وحركات فم مطابقة للكلام مهمة صعبة للغاية، وفقاً لأستاذ التعلم الآلي في كلية لندن الجامعية، ديفيد باربر، الذي لم يشارك في عمل سينثيزيا. ويعود هذا إلى أن المشكلة تتجاوز حركات الفم بكثير، فيجب أن نأخذ بعين الاعتبار الحاجبين، وعضلات الوجه جميعاً، وحركات الكتفين، والحركات الصغيرة العديدة المختلفة التي يستخدمها البشر في التعبير عن أنفسهم.

مصدر الصورة: ديفيد فينتينر

عملت سينثيزيا مع الممثلين من أجل تدريب نماذجها منذ 2020، وتمثّل النسخ الرقمية لهؤلاء الممثلين مجموعة الشخصيات الرقمية الخاصة بالشركة، التي يصل عددها إلى 225 شخصية، وهي متاحة للعملاء لتحريكها بما يتوافق مع نصوصهم الخاصة. لكن سينثيزيا وجدت نفسها في حاجة إلى المزيد من البيانات لتدريب أحدث جيل من شخصياتها الرقمية، ولهذا أمضت السنة الماضية وهي تعمل مع 1,000 ممثل محترف تقريباً في لندن ونيويورك. (تقول سينثيزيا إنها لا تبيع البيانات التي تجمعها، غير أنها تنشر جزءاً منها لأغراض الأبحاث الأكاديمية). كانت الشركة تدفع للممثلين مبالغ مالية لقاء كل مرة تُستخدم فيها شخصياتهم الرقمية، لكنها تدفع لهم الآن رسوماً مقدمة لتدريب نموذج الذكاء الاصطناعي. تستخدم سينثيزيا الشخصيات الرقمية لهؤلاء الممثلين مدة ثلاثة أعوام، وبعدها تعرض عليهم تجديد عقودهم. وعند تجديد العقد، يجب أن يأتوا إلى الاستوديو لإنتاج شخصية رقمية جديدة. أمّا عند رفض تجديد العقد، تحذف الشركة بياناتهم. تُتيح سينثيزيا أيضاً لعملائها من الشركات إمكانية توليد شخصياتها الرقمية الخاصة، وذلك بإرسال شخص ما إلى الاستوديو للمشاركة في عملية مشابهة لما شاركت فيه.

مصدر الصورة: ديفيد فينتينر

مصدر الصورة: ديفيد فينتينر

بين اللقطات، كان فنان الماكياج يأتي لوضع بعض اللمسات حرصاً على الحفاظ على المظهر نفسه في اللقطات جميعها. وشعرتُ بوجنتيّ تزدادان احمراراً بسبب الإضاءة في الاستوديو، وأيضاً بسبب التمثيل. بعد أن جمع الفريق اللقطات المطلوبة كلها لالتقاط تعابيري الوجهية، نزلت إلى الطابق السفلي لقراءة المزيد من النصوص بصوتٍ مرتفع لتسجيل عينات صوتية. كانت هذه العملية تتطلب مني قراءة مقطع يشير إلى أنني أوافق صراحة على استنساخ صوتي، واستخدامه على حساب فويكا على منصة سينثيزيا لإنشاء مقاطع الفيديو والكلام.

الموافقة مسألة مهمة للغاية

هذه العملية مختلفة للغاية عن الطريقة المعتمدة في إنتاج الكثير من الشخصيات الرقمية المُوَلدة باستخدام الذكاء الاصطناعي أو المزيفات العميقة أو الوسائط الاصطناعية، مهما كان المصطلح الذي يروق لك استخدامه. معظم المزيفات العميقة لا تُنتَج داخل استوديو، وقد بيّنت الدراسات أن الأغلبية العظمى من المزيفات العميقة الموجودة على الإنترنت هي محتوى جنسي أُنتِج دون موافقة الأشخاص الذين يظهرون فيه، وعادة ما يُنتَج باستخدام صور مسروقة من منصات التواصل الاجتماعي. جعل الذكاء الاصطناعي التوليدي عملية إنتاج هذه المزيفات العميقة سهلة وقليلة التكاليف، وقد شهدت الولايات المتحدة عدة حالات شهيرة -وأوروبا أيضاً- لاستغلال الأطفال والنساء بهذه الطريقة. كما لفت الخبراء الأنظار أيضاً إلى إمكانية استخدام هذه التكنولوجيا لنشر معلومات مضللة سياسية، وهو تهديد خطير على وجه الخصوص نظراً للعدد القياسي للانتخابات التي ستُجرى في أنحاء العالم كافة هذا العام.

تنصُّ سياسة سينثيزيا على عدم إنتاج شخصيات رقمية لأي شخص دون الحصول على موافقة صريحة منه. لكن تكنولوجيتها ليست في مأمن من سوء الاستخدام. ففي السنة الماضية، اكتشف الباحثون معلومات مزيفة مؤيدة للصين وُلدت باستخدام شخصيات سينثيزيا الرقمية وجمعت بوصفها مواد إخبارية، وهو ما قالت الشركة إنه ينتهك شروط الخدمة. منذ ذلك الحين، لجأت الشركة إلى أنظمة أكثر صرامة للتحقق من الهوية ومراقبة المحتوى.

تطبق الشركة علامة مائية تتضمن معلومات حول مكان وكيفية إنتاج مقاطع الفيديو للشخصيات الرقمية المُوَلدة لأغراض الذكاء الاصطناعي. كما كانت تعتمد سابقاً على أربعة مراقبين للمحتوى داخل الشركة، على حين يمثّل المراقبون الذين يتولون هذه المهمة الآن نسبة 10% من طاقم الشركة الذي يبلغ عدده 300 شخص. أيضاً، وظفت الشركة مهندساً لبناء أنظمة أفضل لمراقبة المحتوى بالاعتماد على الذكاء الاصطناعي. تساعد هذه الفلاتر سينثيزيا على التحقق من أي شيء يحاول عملاؤها توليده. وعند اكتشاف أي شيء غامض أو مثير للشكوك، مثل المحتوى حول العملات المشفرة أو الصحة الجنسية، يُحوَّل إلى مراقبي المحتوى البشريين.

تحتفظ سينثيزيا أيضاً بسجل يتضمن مقاطع الفيديو التي ينتجها نظامها بأكملها. وعلى حين يستطيع أي شخص أن ينضم إلى المنصة، فإن أغلبية الميزات تبقى غير متاحة إلى أن يتجاوز المشترك عملية تدقيق مكثفة مشابهة لعمليات التدقيق في مجال المصارف، التي تتضمن التحدث إلى فريق المبيعات، وتوقيع عقود قانونية، والخضوع لعملية تدقيق أمنية، كما يقول فويكا. تقيّد الشركة عملية إنتاج المحتوى لدى العملاء المشتركين حديثاً بحيث تقتصر على المحتوى المتعلق بوقائع مثبتة حصرياً، ويمكن فقط للعملاء من الشركات الذين يستخدمون شخصيات رقمية خاصة توليد محتوى يحتوي على آراء. إضافة إلى هذا، يُسمح فقط للمؤسسات الإخبارية المعتمدة بإنشاء محتوى يتعلق بالشؤون الجارية. "لا نستطيع أن نزعم بأننا مثاليون. وإذا تلقينا تبليغاً بوجود مشكلة ما، سنتخذ إجراءاتنا بسرعة، مثل تطبيق حظر كلي أو جزئي على الأفراد أو المؤسسات"، كما يقول فويكا. لكنه يعتقد أن هذه الإجراءات رادعة فقط، ما يعني أن معظم الجهات الخبيثة ستلجأ بدلاً من ذلك إلى الاعتماد على الأدوات المفتوحة المصدر والمتاحة مجاناً.

قررت أن أختبر بعضاً من هذه القيود عندما اتجهت إلى مكتب سينثيزيا لتنفيذ الخطوة التالية في عملية إنتاج شخصيتي الرقمية. كان عليّ أن أكتب نصاً لإنشاء مقاطع الفيديو التي ستتضمن شخصيتي الرقمية. وباستخدام حساب فويكا، قررت أن أستخدم مقاطع من مسرحية هاملت، إضافة إلى مقالات سابقة كنت قد كتبتها. استخدمت أيضاً ميزة جديدة على منصة سينثيزيا، حيث يمكنني الاستعانة بمساعد يعمل بالذكاء الاصطناعي لتحويل أي رابط ويب أو مستند إلى نص جاهز للاستخدام. حاولت إنتاج مقطع لشخصيتي الرقمية وهي تقرأ الأخبار حول العقوبات الجديدة التي فرضها الاتحاد الأوروبي على إيران. وعلى الفور، تلقيت رسالة نصية من فويكا: "لقد تسببت لي بمشكلة!"

كان نظام الشركة قد وضع علامة على حسابه بسبب محاولة توليد محتوى غير مسموح به.

يتذمر ريباربيلي ممتعضاً من أن تقديم الخدمات دون هذه القيود سيمثّل "استراتيجية رائعة للنمو". لكن "في نهاية المطاف، لدينا قواعد صارمة للغاية لتحديد ما يمكن إنتاجه وما لا يمكن إنتاجه. ونعتقد أن الطريقة الصحيحة لنشر هذه التكنولوجيا في المجتمع هي تشديد القيود بعض الشيء في البداية". على الرغم من هذا، وحتى لو عملت حواجز الحماية هذه بصورة مثالية، فإننا سنصل على أي حال في نهاية المطاف إلى شبكة إنترنت مليئة بالأشياء المزيفة. وقد جعلتني تجربتي أتساءل بشأن كيفية الاستعداد لوضع كهذا. فمشهد المعلومات لدينا يتسم بالفعل بدرجة عالية من الضبابية والغموض. فمن جهة، ثمة وعي عام متزايد بشأن زيادة انتشار المحتوى المُوَلد باستخدام الذكاء الاصطناعي، واحتمال تحوله إلى أداة مؤثرة لنشر المعلومات المزيفة. ومن جهةٍ أخرى، ما زلنا غير متأكدين من مدى استخدام المزيفات العميقة لنشر المعلومات المزيفة على نطاق واسع، وما إذا كانت تُحدِث أثراً واضحاً في تغيير معتقدات الناس وسلوكياتهم.

اقرأ أيضاً: كيف يؤدي الذكاء الاصطناعي التوليدي إلى تفاقم انتشار المعلومات المزيفة والدعاية المغرضة؟

إذا تجاوزت شكوك الناس إزاء المحتوى الذي يرونه عتبة معينة، فمن المحتمل أن يكفوا عن تصديق أي شيء على الإطلاق، ما يمكن أن يُتيح للجهات الخبيثة فرصة استغلال هذا الفراغ في الثقة، وإطلاق الأكاذيب حول صحة المحتوى الحقيقي. وقد أطلق الباحثون على هذه الظاهرة اسم "أرباح الكاذب". ويحذّر الباحثون من أن يبادر السياسيون، على سبيل المثال، إلى الزعم بأن المعلومات التجريمية الحقيقية هي معلومات مزيفة أو مُوَلدة باستخدام الذكاء الاصطناعي. تقول رئيسة قسم الذكاء الاصطناعي ونزاهة الوسائط في المؤسسة اللاربحية بارتنرشيب أون أيه آي (Partnership on AI)، كلير ليبوفيتش، إنها تشعر بالقلق من أن ازدياد الوعي بوجود هذه الثغرة سيجعل من السهل "إنكار المواد أو الوسائط الحقيقية والتشكيك فيها بصورة معقولة بوصفهاً دليلاً في سياقات عديدة مختلفة، لا في الأخبار وحسب، بل أيضاً في المحاكم، ومجال الخدمات المالية، وفي الكثير من مؤسساتنا". وقالت لي إنها تشعر بالارتياح إزاء الموارد التي كرّستها سينثيزيا لمراقبة المحتوى والحصول على الموافقات، لكنها تقول إن هذه العملية ستعاني بعض العيوب على الدوام.

وحتى ريباربيلي يعترف بأن انتشار المحتوى المُوَلد باستخدام الذكاء الاصطناعي سيتسبب على الأرجح بالمشكلات على المدى القصير. ويُضيف أن الناس ما زالوا يميلون إلى الثقة في الصور ومقاطع الفيديو، على الرغم من أنهم تدربوا على عدم تصديق كل ما يقرؤونه. ويقول إن الناس يحتاجون الآن إلى اختبار منتجات الذكاء الاصطناعي بأنفسهم لرؤية ما يمكن تحقيقه باستخدامها، وإنهم يجب ألا يثقوا بأي شيء يرونه عبر الإنترنت ما لم يتحققوا من صحته. وعلاوة على ما سبق، ما زالت اللوائح التنظيمية للذكاء الاصطناعي مشتتة وتفتقر إلى الاتساق، وما زالت جهود قطاع التكنولوجيا للتحقق من منشأ المحتوى في مراحلها الأولية. هل يستطيع المستهلكون حقاً، مع تفاوت درجاتهم من المعرفة الإعلامية، مواجهة الموجة المتصاعدة من المحتوى الضار المُوَلد باستخدام الذكاء الاصطناعي من خلال العمل الفردي؟

تحذير موجه إلى باوربوينت

في اليوم التالي لزيارتي النهائية، أرسل لي فويكا مقاطع الفيديو مع شخصيتي الرقمية بالبريد الإلكتروني. عندما شغلت المقطع الأول، أصبت بالدهشة. إنه مزعج بمقدار الإزعاج الناجم عن رؤية الشخص لنفسه على الكاميرا أو سماع تسجيل لصوته. بعد ذلك، انتبهت إلى نفسي. ففي البداية، ظننت أن الشخصية الرقمية كانت أنا فعلياً. وكلما شاهدت المزيد من مقاطع الفيديو عن "نفسي"، دخلت في دوامة من التساؤلات. هل أغضّن عيني وأنا أحدق إلى هذه الدرجة حقاً؟ هل أطرف بعيني بهذا القدر؟ هل أحرك فكي على هذا النحو؟ يا إلهي.

إنه عمل متقن. إنه متقن للغاية. لكنه ليس مثالياً. وقد أرسل لي شريك حياتي رسالة نصية تقول: "إنه رسم متحرك متقن على نحو غريب". وأضاف قائلاً: "لكن الصوت يبدو مطابقاً لصوتك أحياناً، ويبدو أحياناً أخرى صوتاً أميركياً خالياً من أي سمات مميزة، مع نبرة غريبة. إنه غريب للغاية".في هذا المقطع المُوَلد بالذكاء الاصطناعي، تقدم "ميليسا" الاصطناعية أداء لمناجاة هاملت الشهيرة.

إنه على حق. فالصوت مطابق في بعض الأحيان لصوتي، لكنني في الحياة الواقعية أستخدم الأصوات التي تدل على التردد (مثل "آممم" و"آه") أكثر من ذلك. لكن الأمر المذهل هو أن النظام تمكن من التقاط سمة العشوائية في طريقة كلامي. فلهجتي تمثل خليطاً عشوائياً عابراً للمحيط الأطلسي، حيث أثرت فيها السنوات التي أمضيتها في المملكة المتحدة، ومشاهدة البرامج التلفزيونية الأميركية، إضافة إلى ارتياد مدرسة دولية. وكانت شخصيتي الرقمية تقول كلمة "روبوت" بلهجة بريطانية أحياناً، وبلهجة أميركية أحياناً أخرى. إنه شيء لم يكن ليلاحظه شخص آخر على الأرجح. لكن نظام الذكاء الاصطناعي تمكن من التقاطه. إضافة إلى ذلك، فإن نطاق المشاعر التي تعبر عنها شخصيتي الرقمية محدود. فهي تلقي الخطاب الشكسبيري "تكون أو لا تكون" بأسلوب واقعي للغاية. وقد وجهت الشخصية الرقمية كي تتحدث بأسلوب غاضب عند قراءة مقال كتبته حول المزيفات العميقة التي تتضمن صوراً عارية للمغنية تايلور سويفت دون موافقتها، وتحدثت الشخصية الرقمية بأسلوب متذمر وحازم بالتأكيد، لكنها لم تبد غاضبة.

ليست هذه المرة الأولى التي جعلت فيها من نفسي مادة لاختبار تكنولوجيات الذكاء الاصطناعي الجديدة. فمنذ فترة قريبة، جربت توليد صور شخصية رقمية لأغراض الذكاء الاصطناعي لنفسي، وكانت النتيجة مجموعة من الصور العارية. كانت هذه التجربة مثالاً صادماً حول التحيز الذي يمكن أن تصل إليه أنظمة الذكاء الاصطناعي. لكن هذه التجربة –وهذه الطريقة بالتحديد في تخليد الصورة- كان مستواها مختلفاً تماماً. بالنسبة إلى الأستاذ المساعد في جامعة أوبسالا، كارل أومان، الذي يدرس الآثار الرقمية، ومؤلف كتاب جديد بعنوان: "مصير البيانات بعد الموت" (The Afterlife of Data)، فإن الشخصيات الرقمية المماثلة للشخصية التي شاركت في إنتاجها "جثث رقمية"، كما يقول، ويضيف قائلاً: "إنها تشبهك تماماً، لكنها بلا روح". ويقول: "إن إنتاج هذه الشخصيات مكافئ لعملية الاستنساخ، لكن النسخة ميتة. وبعدها، يمكنك دفع الجثة إلى الحركة والكلام من خلال نبضات كهربائية".

اقرأ أيضاً: الشخصيات الرقمية في الميتافيرس: المجال الجديد للتشوه الجسمي على الإنترنت

هذا التوصيف قريب من شعوري إزاء هذه الشخصية الرقمية. فتلك الاختلافات الصغيرة الدقيقة التي لا تتطابق مع شخصيتي كافية لإثارة نفوري. من ناحية أخرى، يمكن لهذه الشخصية الرقمية أن تخدع أي شخص لا يعرفني جيداً بسهولة. وتتميز هذه الشخصية الرقمية بأداء رائع للغاية عندما تقدم مقالاً كتبته حول اقتراب مجال الروبوتات من لحظته المفصلية المماثلة للحظة ظهور تشات جي بي تي (ChatGPT) في مجال الذكاء الاصطناعي، فقد لخص المساعد الافتراضي الذي يعمل بالذكاء الاصطناعي المقال الطويل وحوله إلى فيديو قصير لطيف، حيث تتولى شخصيتي الرقمية مهمة القراءة فيه. وعلى الرغم من أن هذا الفيديو ليس بعمل شكسبيري خالد، فإنه أفضل من الكثير مما شاهدته من العروض التقديمية الخاصة بالشركات. أعتقد أنني إذا كنت سأستخدم هذه التكنولوجيا لإنتاج تقرير نهاية السنة الذي سأعرضه على زملائي، فقد يكون هذا المستوى من الأصالة كافياً. وهذه هي النقطة الجذابة التي تستخدمها الشركة لبيع خدماتها، وفقاً لريباربيلي: "ما نقوم به أقرب إلى برنامج باوربوينت (PowerPoint) منه إلى إنتاجات هوليوود".

بعد توليد الشخصية الرقمية، يصبح بإمكان سينثيزيا توليد عروض فيديو تقديمية اعتماداً على نص محدد بسرعة. مصدر الفيديو: سينثيزيا

لا شك في أن الجيل الأحدث من الشخصيات الرقمية ليس جاهزاً للاستخدام في الإنتاج السينمائي. فهذه الشخصيات الرقمية تُعرَض فقط في وضعية العرض الرأسي، وتظهر فقط في وضعية مواجهة للأمام، ومن الخصر حتى الأعلى. لكن في المستقبل القريب، كما يقول ريباربيلي، تأمل الشركة بأن تنتج شخصيات رقمية تستطيع التواصل باستخدام اليدين، وخوض حوارات فيما بينها. كما تخطط أيضاً لإنتاج شخصيات رقمية بجسم مكتمل، وتتمتّع بالقدرة على المشي والتحرك ضمن الفضاء المكاني الذي يولده الشخص. (يذكر أن المنصة التي تُتيح تطبيق هذه التكنولوجيا موجودة حالياً، وفي الواقع فهي موجودة في صورتي في أعلى هذا المقال)

لكن، أهذا ما نريده فعلاً؟ يبدو هذا طريقاً نحو مستقبل كئيب يستهلك فيه البشر محتوى مُوَلداً بالذكاء الاصطناعي وتقدمه إليهم شخصيات رقمية مُوَلدة بالذكاء الاصطناعي، ويستخدمون الذكاء الاصطناعي لإعادة تدوير هذا إلى مزيد من المحتوى، ومن المرجّح أن هذا المحتوى سيُستخلص لتوليد المزيد من الذكاء الاصطناعي. لقد أظهرت لي هذه التجربة على الأقل أن قطاع التكنولوجيا يحتاج بصورة عاجلة إلى تعزيز ممارساته في مراقبة المحتوى وضمان فعالية التقنيات المتعلقة بأصالة المحتوى، مثل إضافة العلامات المائية. وحتى لو لم تكن تكنولوجيا سينثيزيا وأنظمتها لمراقبة المحتوى مثالية بعد، فإنها أفضل بكثير من أي شيء رأيته في هذا المجال من قبل، وهذا بعد سنة تقريباً وحسب من موجة الازدهار الحالية التي يشهدها الذكاء الاصطناعي التوليدي. تسير عملية تطوير الذكاء الاصطناعي بوتيرة عالية للغاية، ومن المثير للحماسة والخوف في الوقت نفسه أن نفكر في درجة التطور التي ستشهدها الشخصيات الرقمية بعد بضعة أعوام وحسب. وقد نُضطر في المستقبل إلى استخدام كلمات مفتاحية مميزة حتى تشير إلى أن الكيان الذي نتواصل معه هو إنسان حقيقي، وليس نظام ذكاء اصطناعي.

لكننا لم نصل إلى هذه المرحلة بعد. لقد راودني شعور غريب بالراحة عندما كانت شخصيتي الرقمية تتحدث بعصبية عن المزيفات العميقة المُنتَجة دون موافقة الأشخاص الذين يظهرون فيها، وقالت بصوت مبتهج على نحو مثير للخوف: "الشركات التكنولوجية العملاقة؟ أجل! إنها تجني أرباحاً خيالية!" هذه عبارة ما كنت لأقولها أبداً.