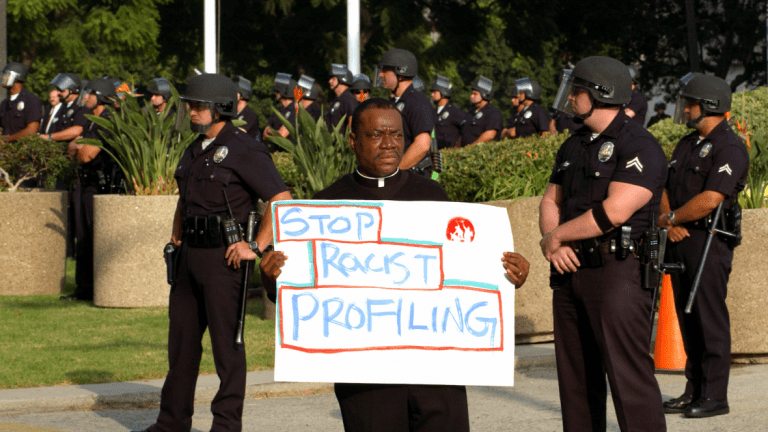

في مايو، 2010، وعلى إثر سلسلة من الفضائح التي أثارت ضجة إعلامية كبيرة، طلب عمدة نيو أورليانز من وزارة العدل الأميركية أن تفتح تحقيقاً حول دائرة الشرطة للمدينة (دائرة شرطة نيو أورليانز NOPD). وبعد عشرة أشهر، قدمت وزارة العدل تحليلاً شديد اللهجة. فخلال الفترة التي غطاها التحقيق، أي منذ 2005 وحتى تاريخ التحقيق، تبين أن دائرة شرطة نيو أورليانز انتهكت القوانين الدستورية والفدرالية بشكل متكرر. ومن هذه الانتهاكات: استخدام القوة المفرطة، وبشكل خاص ضد المواطنين ذوي الأصول الأفريقية، واستهداف الأقليات العرقية والأشخاص الذين لا يتكلمون الإنجليزية كلغة أصلية والأفراد من ذوي الميول الجنسية المغايرة، والفشل في التصدي للعنف الموجه ضد النساء. وقد قال المدعي العام المساعد توماس بيريز في ذلك الحين أن هذه المشاكل كانت "خطيرة، وواسعة النطاق، وشاملة للمنظومة بأكملها، ومترسخة بعمق في ثقافة هذه الدائرة".

على الرغم من هذه الاكتشافات المثيرة للقلق، فقد عقدت سلطات المدينة شراكة سرية بعد عام واحد فقط مع شركة بالانتير للتنقيب في البيانات، وذلك لتطبيق نظام توقع للشرطة. وقد اعتمد النظام على بيانات تاريخية، بما في ذلك سجلات التوقيف والتقارير الإلكترونية للشرطة، وذلك من أجل توقع الجرائم والمساعدة على بناء استراتيجيات السلامة العامة، وفقاً لوثائق الشركة وحكومة المدينة. ولكن هذه الوثائق لم تشر على الإطلاق إلى أية جهود لتنظيف أو إصلاح البيانات على ضوء الانتهاكات التي كشفتها وزارة العدل. ومن المرجح أن هذه البيانات الفاسدة قد تم تلقيمها للنظام بشكل مباشر، بشكل يؤدي إلى تعزيز الممارسات التمييزية لدى تلك الدائرة.

أصبح استخدام خوارزميات الشرطة التوقعية من الممارسات الشائعة في المدن الأميركية. وعلى الرغم من أن نقص الشفافية يجعل من الحصول على أرقام دقيقة أمراً صعباً، فإن بريدبول، وهي من الشركات البارزة التي تبيع هذه الأنظمة، تتباهى بأنها ساعدت على "حماية" واحد من أصل كل 33 شخصاً أميركياً. وغالباً ما يُستخدم البرنامج كوسيلة لمساعدة دوائر الشرطة في توزيع مواردها المحدودة وفق قرارات أكثر فعالية وتعتمد على البيانات.

غير أن أحد الأبحاث الجديدة يشير إلى أن تدريب هذه الأنظمة باستخدام "بيانات قذرة" لا يقتصر على نيو أورليانز. وفي هذا البحث الذي سينشر في مجلة NYU Law Review قريباً، وجد باحثو معهد إيه آي ناو -وهو مركز أبحاث يدرس التأثير الاجتماعي للذكاء الاصطناعي- أن المشكلة واسعة الانتشار في المناطق التي شملتها الدراسة. وتؤثر هذه المسألة بشكل واضح على فعالية أنظمة التوقع وغيرها من الخوارزميات المستخدمة في النظام القضائي الجنائي.

تقول كيت كراوفورد، وهي أحد مؤسسي ومدراء إيه آي ناو ومؤلفة مشاركة في الدراسة: "تتحدد فعالية النظام بجودة البيانات المستخدمة لتدريبه. فإذا كانت البيانات نفسها غير صحيحة، سيؤدي هذا إلى تركيز المزيد من موارد الشرطة على نفس التجمعات السكانية الخاضعة لمراقبة زائدة، والمُستهدفة عرقياً في أغلب الأحيان. أي أن ما حصل فعلياً هو نوع من التبييض التكنولوجي لهذه الممارسات، حيث يفترض مستخدمو هذه الأنظمة أنها أكثر حيادية أو موضوعية بطريقة ما، غير أنها تؤدي في الواقع إلى زرع بذور مخالفة الدستور والقانون".

قام الباحثون بدراسة 13 منطقة نفوذ للشرطة، مركزين على المناطق التي استخدمت أنظمة الشرطة التوقعية، وتعرضت للتحقيقات بطلب من الحكومة. وقد كان الشرط الثاني مطلوباً لضمان وجود توثيق قانوني لممارسات الشرطة. وفي تسعة من تلك المناطق، وجد الباحثون أدلة قوية تشير إلى أن الأنظمة قد تم تدريبها باستخدام "بيانات قذرة".

لم تقتصر المشكلة على اختلال توازن البيانات بشكل يستهدف الأقليات، كما في نيو أورليانز. ففي بعض الحالات، أدت الثقافة السائدة في دوائر الشرطة إلى التلاعب بالبيانات أو تزييفها عمداً تحت ضغوط سياسية شديدة بهدف تخفيض معدلات الجرائم المعترف بها رسمياً. وعلى سبيل المثال، كان قادة أقسام الشرطة في نيويورك يطلبون بشكل منتظم من الضحايا في موقع الجريمة عدم تقديم شكاوى رسمية، وذلك لتخفيف المعدلات الإحصائية للجرائم بشكل مصطنع. وقد وصل الحد ببعض ضباط الشرطة إلى دس المخدرات لدى أشخاص أبرياء بهدف تحقيق الحصة المطلوبة منهم من التوقيفات. وفي أنظمة الشرطة التوقعية العصرية، والتي تعتمد على التعلم الآلي لتوقع الجرائم، تصبح هذه البيانات الفاسدة دلالات نظامية.

تثير نتائج هذا البحث الشكوك حول مصداقية أنظمة الشرطة التوقعية. وغالباً ما يقول مزودو هذه البرمجيات أن النتائج المنحازة لأدواتهم يمكن إصلاحها بسهولة، وفقاً لرشيدة ريتشاردسون، مديرة أبحاث السياسات في إيه آي ناو، والمؤلفة الرئيسية للدراسة: "ولكن في جميع هذه الحالات، هناك مشكلة في النظام تعكسها البيانات". ولهذا، فإن العلاج أعقد بكثير من مجرد عملية حذف بسيطة لبعض البيانات الدالة على سلوك مسيء، فليس من السهل "فصل البيانات الجيدة عن البيانات السيئة، أو رجال الشرطة الجيدين عن رجال الشرطة السيئين" كما يضيف جيسون شولتز، الباحث الأساسي في المعهد في مجال القانون والسياسة وأحد مؤلفي الدراسة.

يقول المزودون أيضاً أنهم يحاولون تجنب البيانات التي يُرجح أنها تعبر عن الانحياز، مثل عمليات التوقيف المتعلقة بالمخدرات، ويفضلون استخدام بيانات أخرى للتدريب مثل اتصالات الطوارئ. ولكن الباحثون وجدوا مقداراً مماثلاً من الانحياز في هذه البيانات التي يُفترض أنها حيادية. إضافة إلى ذلك، فقد وجدوا أن المزودين لم يقوموا بتدقيق البيانات المُلقمة لأنظمتهم بشكل مستقل.

يلقي البحث الضوء على مسألة جدلية أخرى آخر في الولايات المتحدة حول استخدام أدوات التقييم الجنائية، والتي تعتمد أيضاً على التعلم الآلي للمساعدة على تحديد الكثير من الأشياء، بدءاً من مصير المدعى عليهم خلال الإجراءات قبل المحاكمة، وصولاً إلى شدة الأحكام المطبقة عليهم. تقول ريتشاردسون: "إن البيانات التي نناقشها في هذا البحث لا تقتصر فقط على عمل الشرطة، بل إنها مستخدمة في كامل النظام القضائي الجنائي".

حالياً، يركز الجدل بشكل أساسي على آليات النظام نفسه، أي إمكانية تصميمه لإعطاء نتائج عادلة من الناحية الرياضية. ولكن الباحثين يؤكدون على أن هذا ليس السؤال الصحيح. يقول شولتز: "إن محاولة فصل التساؤل حول الخوارزمية عن النظام الاجتماعي المتصل بها والذي يتجسد في كافة نواحيها لن توصلك إلى نتيجة تُذكر. يجب أن نعترف أن محاولات التعامل مع التحيز باستخدام الرياضيات والحسابات محدودة التأثير".

إضافة إلى ما سبق، يأمل الباحثون أن عملهم سيساعد على إعادة تأطير الجدل للتركيز على النظام بأكمله بدلاً من الأداة نفسها، كما يأملون أن هذا البحث سيدفع الحكومات إلى بناء آليات -مثل هيكلية تقييم التأثير الخوارزمي التي أطلقها المعهد السنة الماضية- لزيادة الشفافية والمسؤولية والإشراف على استخدام الأدوات الآلية لاتخاذ القرار.

يقول الباحثون أنه إذا لم يتم إصلاح الآليات الاجتماعية والسياسية التي أدت إلى توليد البيانات القذرة، فإن هذه الأدوات لن تؤدي إلى الفائدة، بل إلى المزيد من الأذى. وما إن يعترف الجميع بهذا، فقد ينتقل الجدل أخيراً، كما تقول ريتشاردسون، إلى "وسائل استخدام التعلم الآلي وغيره من التطورات التكنولوجية للتعامل فعلياً مع السبب الجذري للجرائم. وقد نتمكن من حل مشاكل الفقر والبطالة الإسكان باستخدام البيانات الحكومية بأساليب أكثر جدوى".