في السنوات القليلة الماضية، ظهرت زيادة كبيرة في استخدام تكنولوجيا التعرف على الوجوه وكشفها وتحليلها.

من المرجح أن أكثرها ألفة بالنسبة لك هي أنظمة التعرف على الوجوه، مثل نظام اقتراح الإشارات على الصور في فيسبوك، ونظام آبل آي دي الذي يستطيع التعرف على أشخاص محددين. أما أنظمة الكشف فهي تحدد وجود الوجه بشكل عام، وتقوم أنظمة التحليل بمحاولة تحديد بعض الصفات مثل الجنس والعرق. وتُستخدم جميع هذه الأنظمة حالياً لأهداف مختلفة، بدءاً من التوظيف والبيع بالتجزئة وصولاً إلى الحماية والمراقبة.

يعتقد الكثيرون أن هذه الأنظمة دقيقة وحيادية للغاية. وذلك لأن أفراد أمن المطارات يمكن أن يصابوا بالتعب، ويمكن لأفراد الشرطة أن يخطئوا في تقييم المشتبه بهم، ولكن نظام ذكاء اصطناعي حسن التدريب سيكون قادراً على تحديد هوية الوجوه وتصنيفها بشكل مستمر وبدون أخطاء.

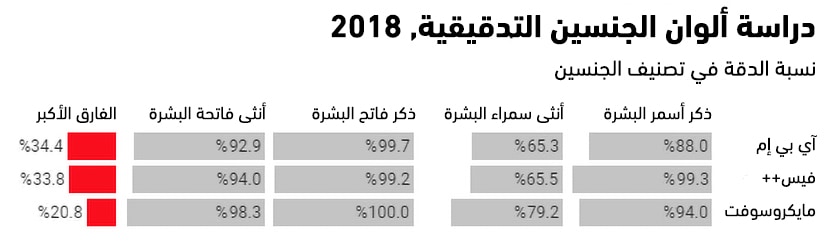

ولكن من الناحية العملية، أظهرت الأبحاث، وبشكل متكرر، أن هذه الأنظمة تتعامل مع بعض المجموعات الديموغرافية بشكل أقل دقة من غيرها. ففي السنة الماضية، وجدت دراسة باسم "ألوان الجنسين"، وهي دراسة مؤثرة أجرتها الباحثة جوي بولامويني من مختبر الميديا في إم آي تي أن أنظمة تصنيف الجنسين، التي تبيعها شركات آي بي إم ومايكروسوفت وفيس بلس بلس، تعاني من نسبة خطأ أعلى بمقدار 34.4% بالنسبة للإناث سمراوات البشرة بالمقارنة مع الذكور من ذوي البشرة الفاتحة، كما وجد الاتحاد الأميركي للحريات المدنية في كاليفورنيا الشمالية، وبشكل مشابه، أن منصة أمازون كانت تخطئ في تحديد أعضاء الكونجرس من ذوي البشرة غير البيضاء أكثر من أقرانهم بيض البشرة.

تكمن المشكلة في أن أنظمة التعرف على الوجوه وأنظمة تحليل الوجوه غالباً ما تُدرب باستخدام مجموعات بيانات مختلة، حيث أن هذه المجموعات تحوي من صور النساء والأشخاص ذوي البشرة السمراء أقل بكثير من صور الرجال والأشخاص من ذوي البشرة البيضاء. وعلى الرغم من أنه يُفترض أن الكثير من هذه الأنظمة تخضع لاختبارات العدالة، فإن هذه الاختبارات لا تتحقق من الأداء على مجال واسع بما فيه الكفاية من الوجوه، كما وجدت بولامويني. وتترسخ هذه التباينات وتؤدي إلى تعزيز التمييز الموجود مسبقاً، وقد تؤدي إلى عواقب وخيمة عند وجود أمور هامة على المحك.

تم نشر ثلاثة أبحاث جديدة مؤخراً، وهي تثير الانتباه المطلوب حول هذه المسألة. إليك وصفاً مختصراً لكل منها.

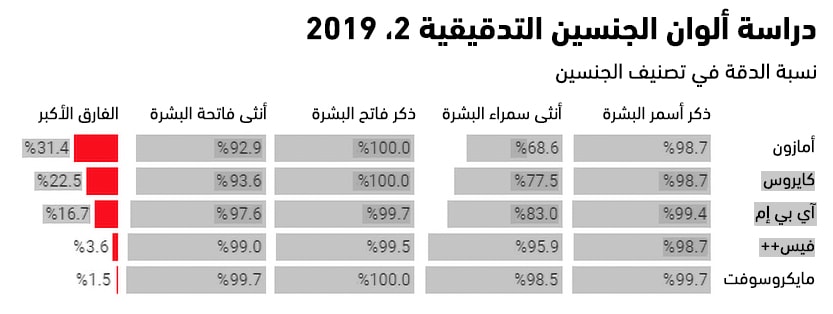

البحث الأول: نشرت بولامويني تحديثاً لألوان الجنسين بإعادة اختبار الأنظمة التي تفحصتها من قبل، وتوسيع دراستها حتى تشمل نظام ريكوجنيشن من أمازون، ونظاماً جديداً من شركة صغيرة للذكاء الاصطناعي تسمى كايروس. وهناك بعض الأخبار الجيدة، فقد وجدت أن آي بي إم وفيس بلس بلس وميكروسوفت قامت جميعاً بتحسين دقة تحديد الجنس بالنسبة للنساء سمراوات البشرة، وقد خفضت مايكروسوفت نسبة الخطأ إلى أقل من 2%. من ناحية أخرى، ما زالت منصتا أمازون وكايروس تعانيان من فارق في الدقة بمقدار 31% و23% على الترتيب، ما بين الذكور ذوي البشرة الفاتحة والنساء السمراوات. وقالت بولامويني أن الدراسة تبين أن هذه التكنولوجيات يجب أن تخضع لتدقيق شديد قبل أن تُعتبر موثوقة بما يكفي.

البحث الثاني: نُشرت دراسة من مختبر علوم الحاسوب والذكاء الاصطناعي (CSAIL) في إم آي تي، وهي تبين فعالية خوارزمية جديدة للتخفيف من التحيز في نظام كشف الوجوه، حتى لو تم تدريبه باستخدام مجموعة شديدة التحيز. فأثناء عملية التدريب، تقوم الخوارزمية أيضاً بتحديد الأمثلة التي لم تأخذ نسبة كافية من البيانات، وتمضي وقتاً إضافياً في تفحصها للتعويض عن هذا النقص. وعندما اختبر الباحثون هذا النظام باستخدام مجموعة بيانات اختبار ألوان الجنسين لبولامويني، وجدوا أنه ساعد على التقليل إلى حد كبير من فرق الدقة ما بين الذكور ذوي البشرة الفاتحة والسمراء، مقارنة مع خوارزمية تدريب معتادة، على الرغم من أنه لم يقض على الفرق تماماً.

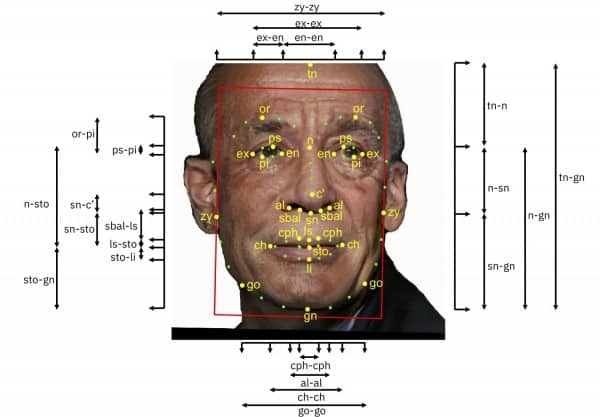

البحث الثالث: نشر قسم الأبحاث في آي بي إم بحثاً يحدد العشرات من الميزات اللازمة لقياس التنوع، بحيث تتجاوز الميزات التقليدية مثل لون البشر والجنس، وتتضمن ارتفاع الرأس، وعرض الوجه، والبعد ما بين العينين، والعمر. وقد بينت هذه النتائج على أبحاث سابقة حول الوجوه البشرية. يقول جون سميث، أحد مؤلفي البحث: "إذا لم يكن لدينا مقاييس واضحة للتنوع الوجهي، فليس من الممكن أن نعود ونفرضها على أنظمة التعرف على الوجوه". وقد أطلق الفريق مع البحث مجموعة بيانات جديدة تتضمن مليون صورة لوجوه مصنفة حسب هذه المقاييس الجديدة.

اتخذت كل من هذه الدراسات خطوات هامة نحو معالجة مسألة التحيز في التعرف على الوجوه، وذلك بتحميل المسؤولية للشركات، وبناء خوارزميات جديدة، وتوسيع فهمنا للتنوع في البيانات. ولكن بناء أنظمة أكثر عدالة ودقة ليس سوى نصف المعركة.

يمكن استخدام جميع الأنظمة، بما فيها أكثرها عدالة ودقة، لانتهاك الحريات المدنية للناس. ففي السنة الماضية، كشف تحقيق لموقع ديلي بيست أن أمازون كانت تسعى إلى عرض منصتها الخاصة بمراقبة الوجوه على إدارة الهجرة والجمارك الأميركية، المعروفة باسم آيس ICE، وذلك لمساعدتها على التعامل مع المهاجرين. وقد كشف تحقيق آخر أن آي بي إم قامت بتطوير القدرة على تحديد الانتماء العرقي من الوجوه في إطار شراكة طويلة مع شرطة مدينة نيويورك. وقد تم تزويد كاميرات المراقبة العامة بهذه التكنولوجيا في ذلك الحين بهدف اختبارها بدون معرفة مواطني المدينة. كما أن شرطة المدن في المملكة المتحدة تستخدم التعرف على الوجوه لمسح الحشود بحثاً عن الأشخاص الموجودين على قوائم المراقبة، وتستخدم الصين هذه التكنولوجيا للمراقبة الجماعية لجميع مواطنيها، لعدة أغراض تتضمن تتبع المعارضين.

استجابة للتزايد السريع لهذه الأنظمة، تزايدت النداءات من ناشطي الحقوق المدنية وأخصائيي التكنولوجيا لوضع قواعد ناظمة لعملها، بل إن جوجل علقت مبيعات أنظمة كهذه إلى حين وضع استراتيجيات واضحة لمنع إساءة استخدامها. تقول بولامويني: "بدون تنظيم الخوارزميات بشكل قانوني، فإن الدقة والعدالة التكنولوجية في الخوارزميات ستؤدي إلى ظهور أدوات تعتمد على الذكاء الاصطناعي ويمكن استخدامها كأسلحة ضدنا".