يكسب الكثيرون المال من يوتيوب. تخيل شعور هؤلاء حين علموا أنهم كانوا ضحية لعملية تصيد احتيالي استهدفتهم. في هذه العملية استخدم المهاجمون تقنية التزييف العميق عبر فيديو مولد بالذكاء الاصطناعي للرئيس التنفيذي ليوتيوب نيل موهان يعلن فيه تغييرات في سياسة تحقيق الدخل من يوتيوب. شارك المهاجمون الفيديو مع منشئي المحتوى المستهدفين وطلبوا منهم اتباع رابط "للتأكد" من امتثالهم للسياسات الجديدة. ليقودهم الرابط إلى موقع تصيد احتيالي مصمم لسرقة بيانات تسجيل الدخول.

⚠️ Heads up: we’re seeing reports of a phishing attempt showing [email protected] as the sender

Be cautious & don’t download/access any file if you get this email (see below)

While our teams investigate, try these tips to stay safe…

— TeamYouTube (@TeamYouTube) شاهد على إكس

لا يوجد حتى اللحظة ما يمنع استخدام تقنية التزييف العميق، سواء في الصوت أو الصورة أو الفيديو، إذ إن استخدامها مسموح به للترفيه. لكن عدد الحالات التي استُخدم فيها التزييف العميق لأهداف خبيثة كان أكثر بكثير من تلك التي للترفيه. سنضع بعين الاعتبار أنه من البديهي أن يُستخدم للترفيه فلا نسمع به، لكن من غير المقبول استخدامه لأهداف أخرى.

لا يحسد أحد يمكن أن يجد نفسه موضوع مادة مولدة بالتزييف العميق، ومع تقدم جودة الوسائط المنتجة بالتزييف العميق إلى الدرجة التي يصعب فيها تمييزها عن الحقيقية، كان لا بد من التكيف مع الأمر، واستخدام الذكاء الاصطناعي للكشف عن المزيفات العميقة، منعاً للضرر الكبير الذي تلحقه بالكثير من الأماكن. وفي هذا المقال نعرض أبرز 5 أدوات مدعومة بالذكاء الاصطناعي وتستخدم للكشف عن المزيفات العميقة.

كاشف التزييف العميق من أوبن أيه آي

أطلقت شركة أوبن أيه آي أداة للكشف عن التزييف العميق، قادرة على تحديد الصور المولدة بالذكاء الاصطناعي بدقة عالية. وتحديداً، يمكنها اكتشاف الصور المولدة بواسطة نموذجها لتوليد الوسائط دال- إي 3 بنسبة نجاح تصل إلى 98.8%. ومع ذلك، تنخفض فاعليتها عند تحليل الصور المولدة بواسطة أدوات ذكاء اصطناعي أخرى، حيث لا تكشف حالياً سوى عن 5-10% منها.

الميزات الرئيسية:

- تعمل الأداة بنظام تصنيف ثنائي، أي تحدد ببساطة ما إذا كانت الصورة مولدة بالذكاء الاصطناعي أم لا.

- تعود الدقة العالية للأداة مع الصور المولدة باستخدام دال-إي3 إلى تضمين أوبن أيه آي بيانات وصفية لا يمكن التلاعب بها في صور دال-إي3، وفقاً لمعيار تحالف منشأ المحتوى وأصالته (C2PA). تعد هذه البيانات الوصفية بمثابة "علامة تعريفية" للوسائط الرقمية، ما يحسن إمكانية تتبع المحتوى.

- إلى جانب الكشف، تعمل أوبن أيه آي أيضاً على وضع علامات مائية على الأصوات المولدة بالذكاء الاصطناعي، والانضمام إلى الجهود المبذولة على مستوى الصناعة، مثل C2PA، لتعزيز مصداقية المحتوى الرقمي.

الأداة للكشف عن الصور المزيفة فقط، ولا توجد معلومات إن كان يمكن استخدامها للكشف عن الفيديوهات المولدة بالتزييف العميق.

اقرأ أيضاً: أوبن إيه آي تطوّر أدوات تكشف الصور والأصوات المولَّدة عبر الذكاء الاصطناعي

هايف أيه آي Hive AI

طورت هايف أيه آي واجهة برمجة تطبيقات فعالة للكشف عن التزييف العميق، وهي مصممة لتحديد المحتوى المولد بواسطة الذكاء الاصطناعي في الصور ومقاطع الفيديو. تعد هذه الأداة مفيدة بشكل خاص لإدارة المحتوى، حيث تساعد المنصات الرقمية على اكتشاف وسائط التزييف العميق وإزالتها، بما في ذلك المواد الإباحية المولدة بواسطة الذكاء الاصطناعي دون موافقة مسبقة والمعلومات المضللة المولدة بواسطة الذكاء الاصطناعي.

الميزات الرئيسية:

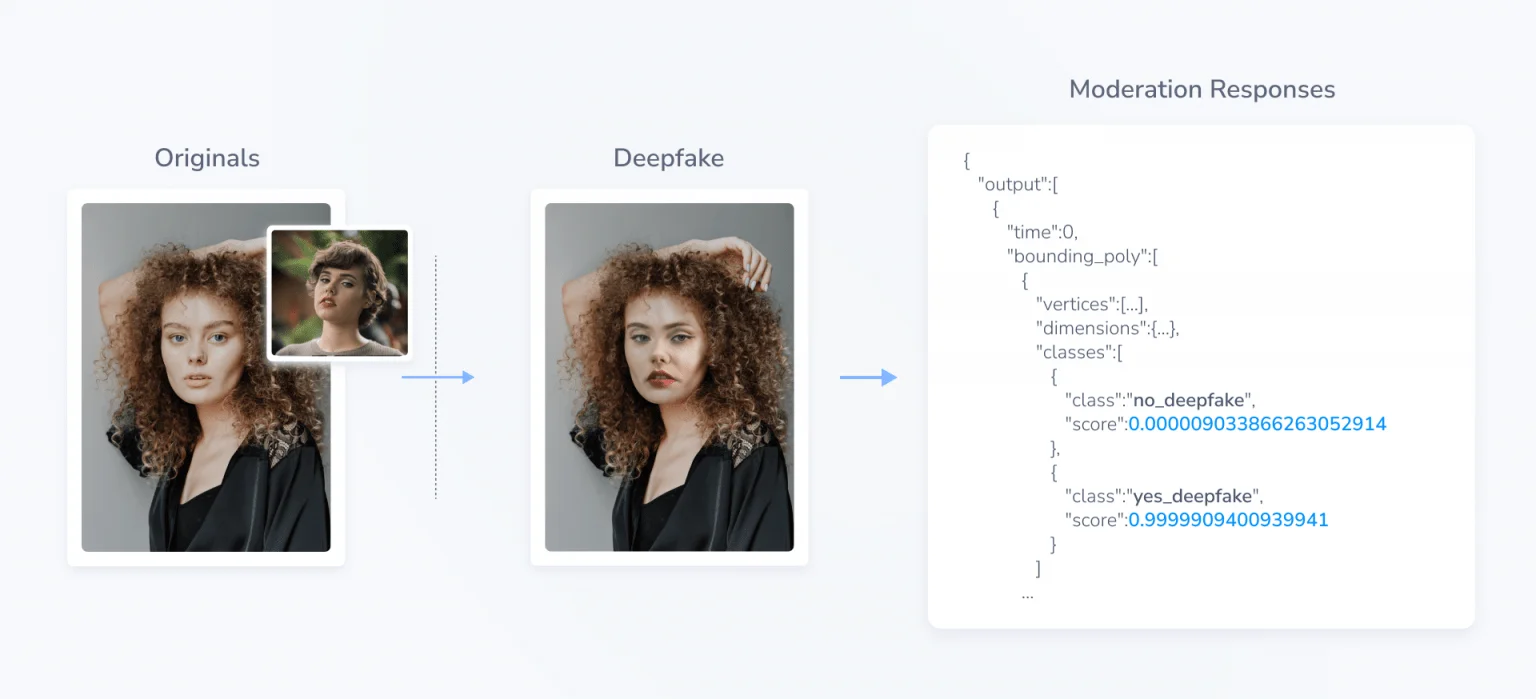

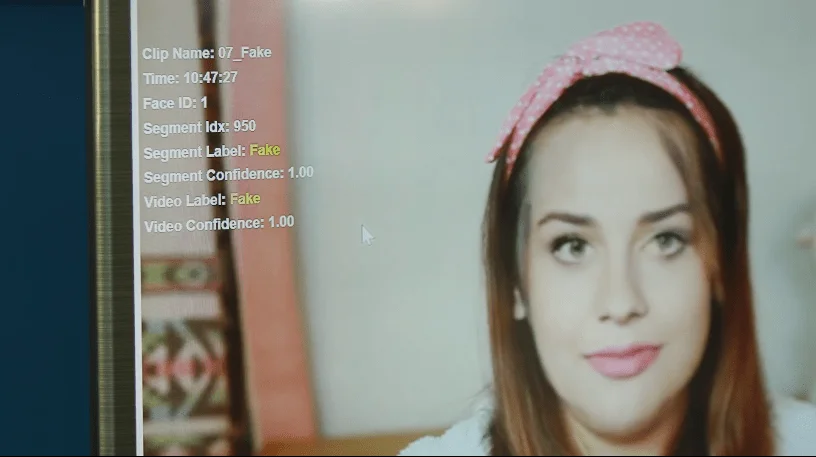

- يعمل نموذج هايف أولاً على اكتشاف الوجوه في إطار الصورة أو الفيديو. ثم يطبق نظام تصنيف، يصنف كل وجه إما "yes_deepfake" وإما "no_deepfake" مع درجة ثقة.

- بفضل تدريبه على مجموعة بيانات متنوعة من مقاطع الفيديو الصناعية والحقيقية، بما في ذلك الأنواع المرتبطة عادةً بالتزييف العميق، يمكن لأداة هايف اكتشاف المحتوى المتلاعب به بواسطة الذكاء الاصطناعي بدقة عالية، حتى عندما يبدو واقعياً للغاية للعين البشرية.

- تدمج واجهة برمجة تطبيقات هايف أيه آي للكشف عن التزييف العميق في منصات اتصالات الفيديو، وخدمات التحقق من الهوية، وأنظمة إدارة المحتوى غير الآمن للعمل (NSFW)، ما يضمن كشف التزييف المولد بواسطة الذكاء الاصطناعي قبل انتشاره.

- تواصل هايف أيه آي تحديث نماذجها مع تطور التزييف العميق، ما يجعلها أحد الحلول التي ينصح بها في مكافحة التزوير الرقمي.

إدراكاً لتداعيات التزييف العميق على الأمن القومي، استثمرت وزارة الدفاع الأميركية 2.4 مليون دولار في أدوات الكشف من هايف أيه آي. وقد اختيرت الشركة من بين 36 شركة لمساعدة وحدة الابتكار الدفاعي في مواجهة التضليل الإعلامي المدعوم بالذكاء الاصطناعي وتهديدات الوسائط المصنعة. وبينما تمثل تقنية هايف خطوة مهمة في مجال الكشف عن التزييف العميق، يشير الخبراء إلى أنه لا توجد أداة مضمونة النجاح، ولا يزال بإمكان المهاجمين إيجاد طرق لتجاوز الكشف.

اقرأ أيضاً: مرشحون للوظائف يستغلون التزييف العميق للمنافسة والحصول على فرص عمل أفضل

سينسيتي أيه آي Sensity AI

هي منصة شاملة للكشف عن التزييف العميق، تستخدم تقنية متطورة مدعومة بالذكاء الاصطناعي لتحليل مقاطع الفيديو والصور والمقاطع الصوتية، وحتى النصوص المولدة بالذكاء الاصطناعي بدقة تتراوح بين 95% و98%.

رسخت سينسيتي مكانتها حلاً مفضلاً للشركات والهيئات الحكومية وشركات الأمن السيبراني التي تسعى لمكافحة الاحتيال وانتشار المعلومات المضللة المدعومة بالذكاء الاصطناعي.

الميزات الرئيسية:

- الكشف متعدد الوسائط: يمكن لسينسيتي اكتشاف عمليات تبديل الوجوه والصوت المتلاعب به ومقاطع الفيديو المزيفة، والصور المولدة بالذكاء الاصطناعي على نطاق واسع.

- المراقبة الفورية: تراقب المنصة باستمرار أكثر من 9000 مصدر لتتبع نشاط التزييف العميق الخبيث.

- التعرف إلى العميل والتحقق من الهوية: تعزز سينسيتي عمليات "اعرف عميلك" (KYC) وتمنع سرقة الهوية من خلال التحقق من صحة الهوية وتقنية مطابقة الوجه، وذلك بدمجها مع حزمة تطوير برامج (SDK) وواجهة برمجة تطبيقات للكشف عن التلاعب بالوجه.

- تطبيقات متعددة القطاعات: تستخدم في إنفاذ القانون، والتحقق من الوسائط، والأمن السيبراني، والتحليل الجنائي الرقمي، حيث تقدم تقييمات آنية للوسائط الرقمية.

- سهلة الاستخدام وقابلة للتطوير: متوفرة كتطبيق ويب وواجهة برمجة تطبيقات ومجموعة أدوات تطوير برمجيات، ما يجعلها في متناول المطورين والمستخدمين غير التقنيين.

- دقة 98%: حيث اكتشفت أكثر من 35,000 عملية تزييف عميق ضارة في العام الماضي وحده، كما تقدم موارد تعليمية لمساعدة الموظفين والمحققين على التعرف إلى تهديدات التزييف العميق، ما يجعلها حلاً شاملاً للشركات التي تولي الأمن الرقمي الأولوية.

تعيد سينسيتي أيه آي تشكيل ثقة الوسائط الرقمية في عصر الذكاء الاصطناعي التوليدي، ما يساعد المؤسسات على استباق التهديدات المدعومة بالذكاء الاصطناعي من خلال الكشف المتطور والمراقبة الفورية.

اقرأ أيضاً: هل ستحظى نماذج التزييف العميق بسمعة جيدة يوماً ما؟

فيك كاتشر FakeCatcher من إنتل

فيك كاتشر من إنتل أول كاشف تزييف عميق في الوقت الفعلي، حيث يحلل الإشارات البيولوجية لتحديد مصداقية الفيديو.

الميزات الرئيسية:

- بخلاف كواشف التزييف العميق التقليدية القائمة على الذكاء الاصطناعي، التي تعتمد على التناقضات في حركات الوجه أو تشوهات البكسل، يستخدم فيك كاتشر تقنية التصوير الضوئي (PPG)، وهي تقنية تكشف التغيرات الطفيفة في تدفق الدم من بكسلات الفيديو.

- يتيح هذا النهج التمييز بين الفيديوهات الحقيقية والفيديوهات المولدة بالذكاء الاصطناعي في غضون ميلي ثانية.

- يعمل فيك كاتشر على معالجات Intel® Xeon® Scalable من الجيل الثالث، ويدعم ما يصل إلى 72 بثاً لكشف التزييف العميق في الوقت الفعلي في آنٍ واحد.

- وفقاً لإنتل فإن نموذجها يحقق دقة 96% في ظل ظروف متحكم بها، ودقة 91% عند اختباره على فيديوهات التزييف العميق "الطبيعية".

- يحلل النظام أيضاً أنماط حركة العين، حيث غالباً ما تظهر مقاطع التزييف العميق محاذاة غير طبيعية للعين.

تشمل التطبيقات المحتملة لفيك كاتشر ما يلي:

- الإعلام والبث: التحقق من صحة لقطات الجهات الخارجية في إنتاج الأخبار.

- وسائل التواصل الاجتماعي: فحص مقاطع الفيديو التي ينشئها المستخدمون للتلاعب بها بواسطة الذكاء الاصطناعي.

- أدوات إنشاء المحتوى: دمج الكشف الفوري في برامج تحرير الفيديو.

- الذكاء الاصطناعي من أجل الصالح العام: توفير منصة متاحة على نطاق واسع للتحقق من صحة مقاطع الفيديو.

في حين أن فيك كاتشر يظهر نتائج واعدة، يحذر باحثون مستقلون من أن فاعليته في سيناريوهات العالم الحقيقي تحتاج إلى مزيد من التحقق. يمكن لعوامل مثل دقة الفيديو والإضاءة أن تؤثر في دقة الكشف، كما أن النظام لا يحلل الصوت. ومع ذلك، يمثل ديب كاتشر قفزة نوعية في مجال كشف مقاطع التزييف العميق من خلال الاستفادة من السمات البيولوجية البشرية لفصل الواقع عن الخداع الناتج عن الذكاء الاصطناعي.

اقرأ أيضاً: كيف يمكنك كشف فيديوهات التزييف العميق بسهولة؟

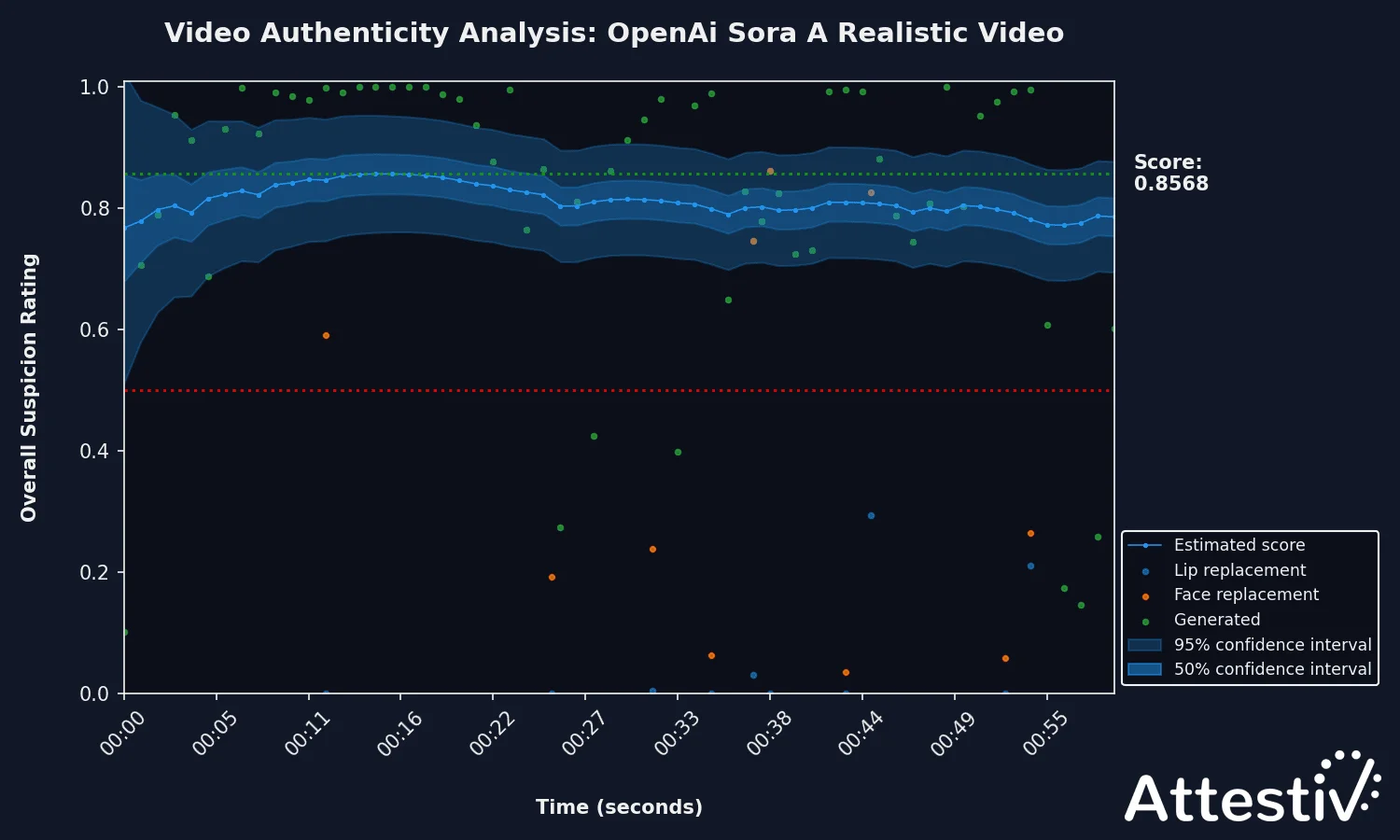

أتيستيف Attestiv للكشف عن مقاطع الفيديو المزيفة

منصة للكشف عن مقاطع الفيديو المزيفة مدعومة بالذكاء الاصطناعي ومتخصصة في مصادقة مقاطع الفيديو والتحليل الجنائي. صُممت أتيستيف للشركات والأفراد على حد سواء، وتساعد على الكشف عن مقاطع الفيديو المزيفة، والتعديلات المولدة بالذكاء الاصطناعي، والتعديلات المشبوهة في مقاطع الفيديو.

الميزات الرئيسية:

- تتضمن عملية الكشف في أتيستيف فحصاً جنائياً للفيديو، الذي يفحص جوانب مختلفة مثل استبدال الوجوه، وتعديلات مزامنة الشفاه، ومحتوى الذكاء الاصطناعي المولد، والتعديلات المشبوهة.

- تحدد المنصة تصنيفاً عاماً للشك (1-100) لقياس احتمالية التلاعب، ما يسمح للمستخدمين بتقييم صحة الفيديو بسرعة.

- من أهم ميزات أتيستيف تقنية البصمة الرقمية الخاصة بها، التي تعين توقيعاً رقمياً فريداً لكل فيديو. تخزَن هذه البصمات في سجل ثابت، ما يضمن الكشف الفوري عن أي تعديلات مستقبلية.

أطلقت أتيستيف مؤخراً ميزة تحليل السياق، وهي ميزة متقدمة تفحص بيانات تعريف الفيديو والأوصاف والنصوص المكتوبة للكشف عن عمليات الاحتيال بتقنية التزييف العميق والتلاعب المولد بالذكاء الاصطناعي. يعزز هذا التحسين قدرة أتيستيف على التحقق من صحة المحتوى الرقمي ومنع المعلومات المضللة وهجمات التصيد الاحتيالي وتداول الوسائط الاحتيالية.

يمكن الوصول إلى المنصة عبر تطبيق ويب وتكامل واجهة برمجة التطبيقات (API)، مع إصدار مجاني يسمح بما يصل إلى خمس عمليات مسح ضوئي للفيديو شهرياً. يمكن للشركات الترقية إلى باقات مميزة لتحسين دقة المسح وتحليل أسرع، وأمان على مستوى المؤسسة.

اقرأ أيضاً: مصادقة الهوية السريعة على الإنترنت

لماذا يجب مكافحة المزيفات العميقة؟

مكافحة المزيفات العميقة تزداد أهمية مع ازدياد حرفية إنشائها للأسباب التالية:

- تُستخدم تقنية التزييف العميق في عمليات احتيال متزايدة التعقيد، ما يصعب على الأفراد والشركات التمييز بين الحقيقي والمزيف.

- استخدم المحتالون الأصوات المولدة بالذكاء الاصطناعي لانتحال شخصيات المدراء التنفيذيين، ما أدى إلى خسائر مالية.

- يستغل مجرمو الإنترنت التزييف العميق لسرقة الهوية وهجمات التصيد الاحتيالي. ويتعين على الشركات التي تعتمد على مصادقة الصوت والتحقق الرقمي الآن استخدام أدوات كشف لحماية البيانات الحساسة ومنع الاحتيال.

اقرأ أيضاً: جوجل تتخذ إجراءات للحد من ظهور المزيفات العميقة المسيئة في نتائج البحث

إلى جانب المخاطر المالية:

- تشكل المزيفات العميقة تهديداً متزايداً لنزاهة وسائل الإعلام وثقة الجمهور، إذ يمكن استخدام مقاطع الفيديو المتلاعب بها والخطابات المولدة بالذكاء الاصطناعي لنشر معلومات كاذبة، لا سيما في أثناء الانتخابات أو الفعاليات السياسية.

- مع تسارع انتشار المحتوى الرقمي بفضل وسائل التواصل الاجتماعي، أصبح ضمان قدرة المؤسسات والمنصات الإخبارية على التحقق من صحة مقاطع الفيديو والصور أكثر أهمية من أي وقت مضى.

- في قطاعات مثل البنوك وإنفاذ القانون والأمن السيبراني، يعد كشف التزييف العميق أمراً بالغ الأهمية لمنع الوصول غير المصرح به والحفاظ على أنظمة مصادقة آمنة.

- تستخدم العديد من المؤسسات الآن أدوات مدعومة بالذكاء الاصطناعي لتحليل البيانات البيومترية والتحقق من الهويات واكتشاف الوسائط المولدة قبل أن تسبب ضرراً.

- مع تطور تقنية التزييف العميق، سيكون وجود حلول كشف موثوقة أمراً ضرورياً للحفاظ على الثقة والأمان في عالم يعتمد بشكل متزايد على الذكاء الاصطناعي.