أثبت عددٌ من الباحثين تجريبياً أنه يمكن خداع نظام عصري للتعرف على الوجوه بحيث يرى شخصاً غير موجود فعلياً.

فقد قام فريق من شركة مكافي للأمن السيبراني بتصميم هجوم ضد نظام تعرف على الوجوه يماثل الأنظمة المستخدمة حالياً في المطارات للتأكد من جوازات السفر. وباستخدام التعلم الآلي، قام الباحثون ببناء صورة تبدو شبيهة بشخص معين بالنسبة للعين البشرية، ولكنها تبدو بالنسبة لنظام التعرف على الوجوه شخصاً آخر، بشكل يتيح على سبيل المثال خداع النظام للسماح لشخص ما بالصعود على متن رحلة جوية على الرغم من ورود اسمه على قائمة حظر السفر.

يقول ستيف بوفولني، المؤلف الأساسي للدراسة: "في حال استخدام كاميرا تعمل بشكل مباشر على تحديد هوية الشخص أمامها، ومقارنتها بصورة جواز السفر، يمكن بشكل واقعي ومتكرر أن نتسبب بهذا النوع من التصنيف الخاطئ الموجَّه".

مبدأ العمل

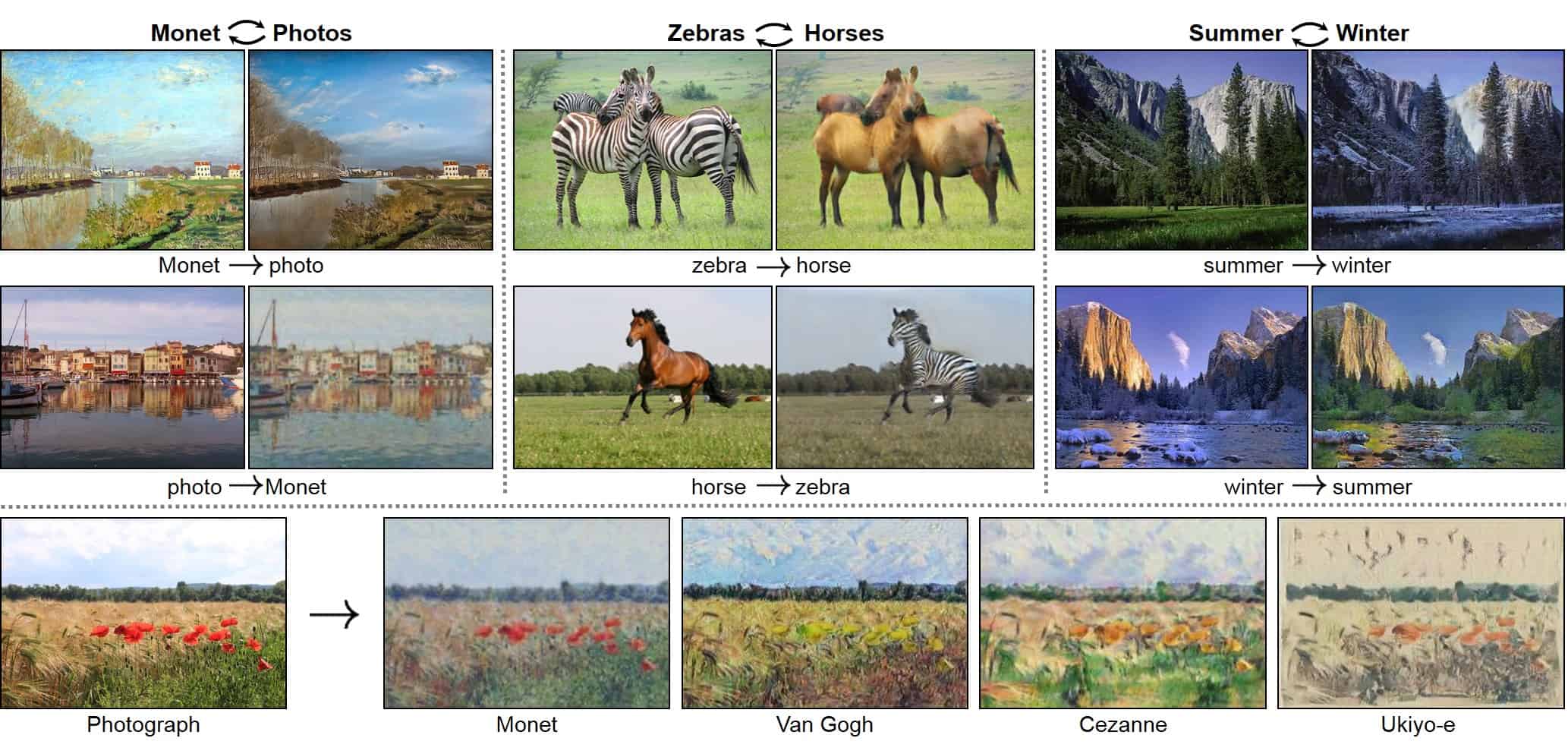

لخداع الخوارزمية، استخدم الباحثون خوارزمية ترجمة الصور المعروفة باسم سايكل جان (CycleGAN)، والتي تقدم نتائج ممتازة في تحويل الصور الفوتوغرافية من أسلوب إلى أسلوب آخر. وعلى سبيل المثال، يمكن أن تقوم الخوارزمية بتحويل صورة ميناء لتبدو وكأنها من أعمال الرسام الفرنسي مونيه، أو تجعل صورة تُظهر عدداً من الجبال في فصل الصيف تبدو وكأنها التُقطت في فصل الشتاء.

استخدم فريق مكافي 1,500 صورة لكل من المؤلفين الرئيسيين في المشروع، وزوَّدوا خوارزمية سايكل جان بالصور لجعل كل شخص منهم يبدو على هيئة شخص آخر من نفس المجموعة. وفي نفس الوقت، استخدم الفريق خوارزمية التعرف على الوجوه لتفحص الصور التي ولدتها خوارزمية سايكل جان والحصول على هويات الأشخاص التي تعرفت عليها. وبعد توليد مئات الصور، توصلت خوارزمية سايكل جان في نهاية المطاف إلى توليد صورة مزيفة تبدو وكأنها تعود للشخص A للعين المجردة، ولكنها تستطيع خداع نظام التعرف على الوجوه بحيث يعتقد أنها تعود للشخص B.

على الرغم من أن هذه الدراسة تثير مخاوف واضحة حول مناعة أنظمة التعرف على الوجوه، إلا أنه لا بد من أن نأخذ بضعة أمور بعين الاعتبار. أولاً، لم يتمكن الباحثون من إجراء التجربة على النظام الفعلي المستخدم في المطارات للتعرف على المسافرين، وبدلاً من ذلك، استخدموا نظاماً حديثاً يعتمد على خوارزمية مفتوحة المصدر. يقول بوفولني: "أعتقد أن استحالة الوصول إلى النظام الهدف ستكون أصعب مشكلة بالنسبة لأي مهاجم". ولكن، ونظراً للتشابهات بين خوارزميات التعرف على الوجوه، فإنه يعتقد أن الهجوم سينجح على الأرجح حتى مع النظام الحقيقي المستخدم في المطارات.

كيف تعمل شبكات جان

- تُعرف شبكات جان GAN (اختصاراً لعبارة الشبكات التنافسية التوليدية) على أنها نوع من الخوارزميات التي تتمتع بتصميم ذكي يقوم على إحداث تنافس بين شبكتين عصبونيتين لتوليد نتائج أفضل.

- في الشكل التقليدي لهذا النوع من الشبكات، تُستخدم شبكتان فقط: شبكة التوليد التي تتدرب على مجموعة بيانات –مثل صور منظر صيفي- لتوليد المزيد من صور المناظر الصيفية، وشبكة التقييم التي تقارن الصور المولدة مع نفس مجموعة البيانات حتى تقرر ما إذا كانت حقيقية أو مزيفة.

- غير أن خوارزميات سايكل جان تقوم بتعديل هذه العملية، حيث توجد فيها شبكتان للتوليد وشبكتان للتقييم. هناك أيضاً مجموعتان للصور، مثل المناظر الصيفية والشتوية، وتمثلان نوعي الصور التي ستتم الترجمة بينهما.

- في هذا النظام، تتدرب الشبكة المولدة الأولى على صور المناظر الصيفية بهدف توليد مناظر شتائية. أما الشبكة المولدة الثانية فتتدرب على المناظر الشتوية لتوليد مناظر صيفية. وتعمل شبكتا التقييم على اكتشاف التزييف بشكل دقيق؛ حتى تصل الصور المزيفة إلى مرحلة من الدقة يتعذر فيها تمييزها عن الصور الحقيقية.

ثانياً، يتطلب هجوم كهذا الكثيرَ من الوقت والموارد. تحتاج خوارزميات سايكل جان إلى حواسيب قوية وخبرات عالية للتدريب والتنفيذ.

ولكن أنظمة التعرف على الوجوه وأنظمة المعالجة الآلية لجوازات السفر أصبحت تُستخدم على نحو متزايد في المطارات حول العالم، وهي نقلة تسارعت بسبب وباء كوفيد-19، والرغبة في الانتقال إلى أنظمة لا تحتاج إلى اللمس. كما أن هذه التكنولوجيا تُستخدم على نطاق واسع من قِبل الحكومات والشركات في مجالات مثل فرض القانون، والتوظيف، وحماية التجمعات والمناسبات، على الرغم من أن الكثير من المجموعات دعت إلى تعليق تطوير هذه الأنظمة، بل إن بعض المدن حظرت استخدام هذه التكنولوجيا.

توجد محاولات تقنية أخرى لخداع أنظمة التعرف على الوجوه؛ فقد قام فريق من جامعة شيكاغو مؤخراً بإطلاق فوكس Fawkes، وهي أداة من أجل "حجب" الوجوه عن طريق تعديلات طفيفة على صورك في مواقع التواصل الاجتماعي، وذلك لخداع أنظمة الذكاء الاصطناعي التي تعتمد على قواعد بيانات تتضمن المليارات من هذه الصور. كما قام باحثون من شركة نيرون للذكاء الاصطناعي باستعراض كيفية استخدام الأقنعة لخداع أنظمة التعرف على الوجوه المستخدمة في جميع أنحاء العالم.

يقول باحثو مكافي إن هدفهم النهائي هو توضيح وجود نقاط ضعف كامنة في بنية هذه الأنظمة، وضرورة استمرار الإشراف البشري عليها.

يقول بوفولني: "لا شك في أن أنظمة الذكاء الاصطناعي وأنظمة التعرف على الوجوه أدوات قوية للغاية في مساعدة عملية تحديد هويات الأشخاص ومعالجتها. ولكن إذا تم إحلال هذه الأنظمة بثقة عمياء محل أنظمة حالية تعتمد بشكل كلي على البشر من دون أي تدقيق إضافي، فستكتشف فجأة أنك ربما زرعت نقطة ضعف أكثر خطورة مما كان موجوداً قبل ذلك".